ECサイトの価格、求人情報、口コミ、在庫、ニュース、SNSの投稿数など、Web上の情報は常に変化しています。こうした更新頻度の高い情報を、できるだけ遅れなく継続的に取得し、分析や監視に活用するのがリアルタイムデータ取得です。

しかし実際には、近年のWebサイトの多くがJavaScriptを使った動的ページで構成されており、HTMLを開いただけでは必要な情報が取得できないケースが増えています。特に、一覧の追加読み込みや検索結果の更新、価格や在庫の反映などがAjax通信によって行われている場合、通常の方法ではデータ取得が安定しないことがあります。

本記事では、リアルタイムデータ取得の基本から、Ajaxデータ取得との関係、動的ページで取得が難しくなる理由、安定してデータ収集するための考え方まで、実務で使える視点でわかりやすく解説します。

リアルタイムデータ取得とは

リアルタイムデータ取得とは、更新された情報をできるだけ早く自動的に収集し、分析・通知・監視・蓄積に活用できる状態にすることです。

たとえば、次のような用途で使われます。

- 競合サイトの商品価格の監視

- 求人情報の新着掲載チェック

- 在庫変動の検知

- 口コミやレビューの継続収集

- ニュースや記事公開のモニタリング

- SNS投稿やトレンドの変化把握

ここで重要なのは、Web上の「リアルタイム」は必ずしもミリ秒単位のストリーム処理を意味しないことです。多くの業務では、数分〜数十分単位で継続的に取得できれば十分に実用的です。つまり、Webデータ取得の文脈では、厳密なリアルタイム処理よりも、実務に必要なタイミングで安定して更新データを取得できることが重要になります。

リアルタイム処理・準リアルタイム処理・バッチ処理の違い

リアルタイムデータ取得を考えるときは、処理方式の違いを整理しておくとわかりやすくなります。

| 項目 | リアルタイム | 準リアルタイム | バッチ |

|---|---|---|---|

| 取得タイミング | ほぼ即時 | 数分〜数十分ごと | 数時間ごと、1日1回など |

| 主な目的 | 即時監視、アラート、通知 | 継続監視、定期更新、業務活用 | 集計、分析、定点観測 |

| 向いているケース | 価格急変監視、在庫変動通知、不正検知 | 求人新着チェック、競合調査、レビュー収集 | レポート作成、日次集計、履歴蓄積 |

| メリット | 鮮度が高い | 鮮度と安定性のバランスがよい | 運用しやすく、大量処理に向く |

| 注意点 | 負荷が高くなりやすい | 間隔設計が重要 | 即時性は低い |

| Webデータ取得との相性 | 対象サイトによっては難しい | 最も現実的で実務向き | 分析用途では有効 |

リアルタイム処理

データが発生してからほぼ即時に取得・処理する方法です。監視、アラート、即時通知など、遅延の少なさが重視される場面に向いています。

準リアルタイム処理

数分おき、10分おき、30分おきなど、一定間隔で自動取得する方法です。Webスクレイピングではこの形がもっとも現実的で、業務でも使いやすい運用方法です。

バッチ処理

1日1回、数時間おきなど、まとまった単位でデータを収集・処理する方法です。傾向分析や定点観測には向いていますが、変化への即応性は低くなります。

Webサイトからのデータ取得では、対象サイトの更新頻度やアクセス制限、業務上必要な鮮度とのバランスを見て、準リアルタイム運用を選ぶケースが多くなります。

なぜ動的Webサイトでは データ取得が難しいのか

従来の静的ページであれば、ページを開いたときのHTML内に必要な情報が含まれているため、比較的簡単にデータ取得できます。

一方で、最近のWebサイトでは、次のような仕組みがよく使われています。

- ページ表示後にJavaScriptでデータを読み込む

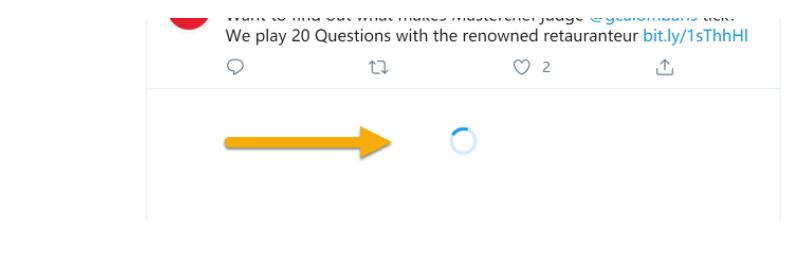

- スクロールすると続きのデータが追加表示される

- ボタンを押すと一覧が更新される

- 検索条件の変更に応じて結果が非同期で切り替わる

- 一部の情報だけが後からAPI経由で取得される

このようなページでは、初期HTMLには必要なデータが含まれておらず、後からブラウザ上でデータが描画されることがあります。そのため、単純にHTMLを取得するだけでは、画面に見えている情報を正しく収集できません。

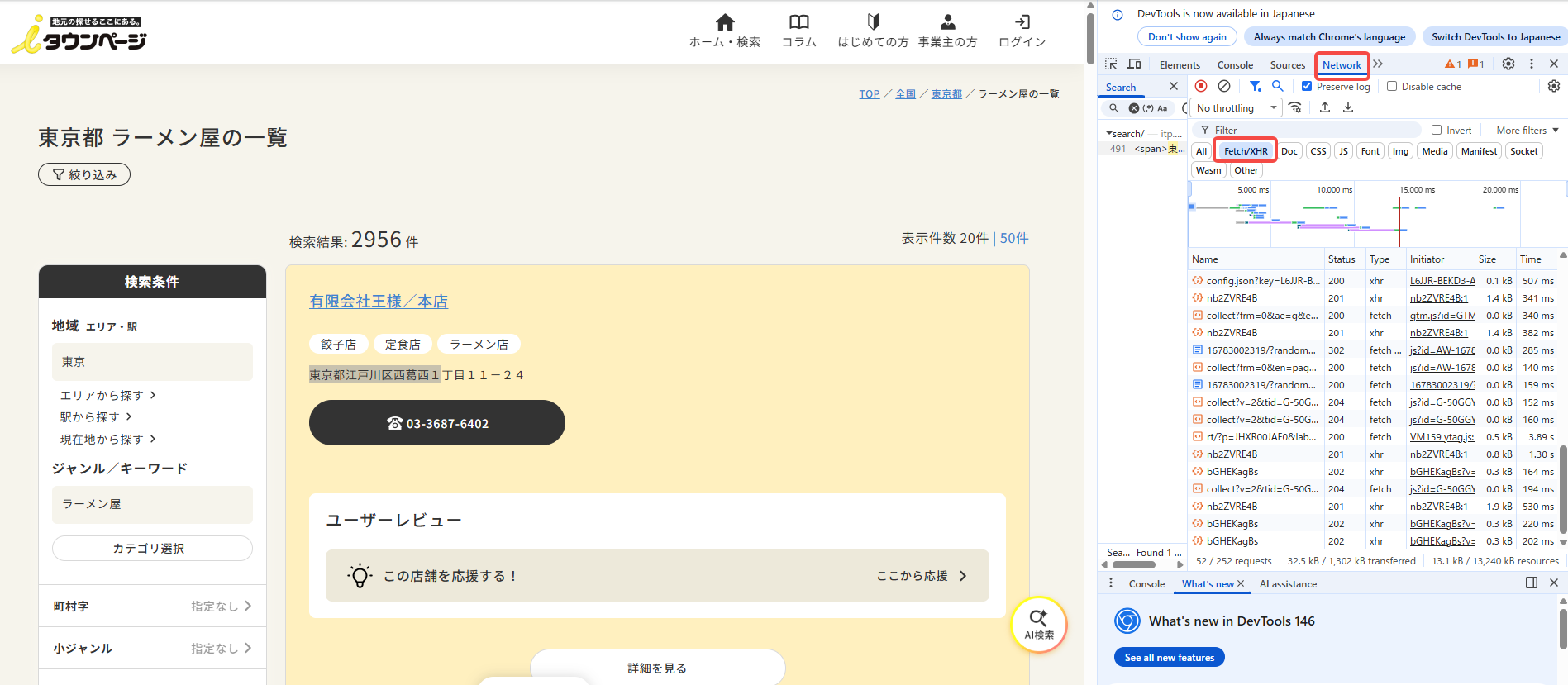

Ajaxデータ取得とは

Ajaxとは、ページ全体を再読み込みせずに、必要なデータだけをサーバーとやり取りして画面の一部を更新する仕組みです。こちらは Ajax読み込み の説明記事です。

たとえば、次のような動きはAjaxが使われている可能性があります。

- 「もっと見る」を押すと商品一覧が追加される

- 絞り込み条件を変えると一覧だけが切り替わる

- ページ遷移なしで口コミやコメントが増える

- 入力中に候補一覧が自動更新される

このような場合、画面に表示されているデータは、裏側で別のURLやAPIから取得されていることがあります。つまり、Ajaxデータ取得とは、こうした非同期通信で取得・表示されているデータを見つけて収集することです。

実務上は、Ajaxという言葉だけでなく、fetch、XHR、JSONレスポンス、内部API、無限スクロールなどの仕組みと合わせて理解することが重要です。

動的ページのデータ取得でよくある4つのパターン

動的Webサイトのデータ取得は、次の4パターンに分けて考えると整理しやすくなります。

1. HTML内にすでに情報がある

画面に見える情報が最初からHTMLに含まれているケースです。この場合は比較的シンプルに取得できます。

2. AjaxやAPIでJSONデータを取得している

画面表示に必要な情報が、裏側のAPIレスポンスとして返されているケースです。この場合は、対象の通信先を見つけられれば効率よく取得できる可能性があります。

3. JavaScriptでDOMを書き換えて表示している

データ自体は取得済みでも、表示形式が複雑で、最終的な描画結果を待たないと情報を拾えないケースです。

4. スクロールやクリックで追加読み込みされる

一覧の続きを読み込むには、ユーザー操作を再現する必要があるケースです。待機、クリック、スクロールなどの制御が重要になります。

この違いを見極めずに取得処理を作ると、一部しか取れない、重複する、途中で止まる、空欄が増えるといった問題が起こりやすくなります。

リアルタイムデータ取得でまず確認すべきポイント

リアルタイムで安定運用したい場合、最初に見るべきなのは「そのページがどうやってデータを表示しているか」です。

特に次の点を確認すると、取得方針が立てやすくなります。

- データは初期HTMLにあるか

- 通信で別データを読んでいるか

- 画面操作が必要か

- 更新頻度はどの程度か

- 対象サイトの制限は強いか

動的Webサイトからデータ取得する3つの方法

1. 公式APIを利用する

もっとも安定しやすい方法です。対象サービスが公式APIを提供している場合は、まずAPI利用可否を確認するのが基本です。

- 向いているケース:提供元がAPIを公開している/利用規約が明確/構造化データを安定取得したい

- 注意点:利用制限や認証がある/欲しい項目がAPIで取れないことがある/仕様変更に追随が必要

2. プログラムで自作する

PythonやJavaScriptで、API通信やブラウザ操作を自分で制御する方法です。

- 向いているケース:技術者が社内にいる/細かい制御が必要/特殊要件がある

- 注意点:開発・保守コストが高い/サイト変更のたびに修正が必要/運用が属人化しやすい

3. スクレイピングツールを使う

ブラウザ操作や待機処理をGUIで設定しながら、自動収集を行う方法です。

- 向いているケース:開発工数を抑えたい/定期実行したい/非エンジニアでも扱いたい

- 注意点:対象サイトによって難易度差がある/設定次第で取得漏れや重複が起こる/リアルタイム性と安定性のバランス設計が必要

リアルタイムデータ取得でOctoparseを活用するメリット

リアルタイムデータ取得を実現するうえで、重要なのは「必要なデータを継続的かつ効率的に取得できるか」です。特に、AjaxやJavaScriptを利用した動的Webサイトでは、通常の静的なデータ取得では情報を正しく取得できないことがあります。

その点、Octoparseは動的ページやAjax読み込みにも対応しており、クリック、スクロール、待機、ページ遷移などの操作を組み合わせながら、実際の画面表示に近い形でデータ取得フローを構築できます。これにより、価格情報、求人情報、レビュー、在庫情報など、変化しやすいデータの継続取得に活用しやすいのが特長です。

また、スケジュール実行やクラウド実行を活用することで、一定間隔での自動取得にも対応しやすくなります。リアルタイム処理そのものだけでなく、準リアルタイムでの監視や定期更新にも適しているため、競合調査、市場分析、営業リスト作成、モニタリング業務など、さまざまな用途で活用できます。

さらに、取得したデータはGoogleスプレッドシートやExcel、CSVなどにエクスポートできるため、取得後の共有・分析・加工までスムーズにつなげやすい点もメリットです。リアルタイムデータ取得を現場で運用するには、取得できることに加えて、その後の活用まで含めて設計することが重要であり、その点でもOctoparseは実務に取り入れやすいツールといえます。

動的ページを安定して取得するための実践ポイント

リアルタイムデータ取得では、取得できること以上に、毎回安定して同じように取得できることが大切です。そのため、以下の点を意識すると運用しやすくなります。

- 表示完了を待つ

- クリックやスクロールを明示する

- 取得件数の増減を確認する

- 更新頻度を上げすぎない

- サイト変更に備える

リアルタイムデータ取得が役立つ具体例

- 競合価格のモニタリング

- 求人市場の変化把握

- レビュー・口コミ分析

- 在庫・販売状況のチェック

- コンテンツ更新の監視

リアルタイムデータ取得を導入する前考えるべきこと

- 何をどの頻度で取得したいのか

- その鮮度は本当に業務上必要か

- 取得後にどのように活用するか

- 安定運用のためにどこまで保守するか

- 対象サイトの構造や制限にどれだけ対応が必要か

- 取得対象サイトの利用規約を確認する

- サーバーへ過度な負荷をかけない

単に「できるだけ速く取りたい」と考えるより、目的に合った粒度で継続取得できる設計のほうが、結果的に業務で使いやすくなります。

FAQ(よくある質問)

Q1. リアルタイムデータ取得と通常のWebスクレイピングの違いは何ですか?

通常のWebスクレイピングは単発取得や定期取得も含む広い概念です。リアルタイムデータ取得は、その中でも更新頻度の高い情報を短い間隔で継続的に収集し、すぐ活用できるようにする運用を指します。

Q2. Ajaxデータ取得とは何ですか?

Ajaxデータ取得とは、ページ全体を再読み込みせずに非同期通信で取得されるデータを収集することです。検索結果一覧、レビュー追加表示、条件絞り込みなどでよく使われます。

Q3. 動的Webサイトはなぜ取得しにくいのですか?

画面表示後にJavaScriptで情報を読み込むため、初期HTMLに必要なデータが入っていないことが多いからです。そのため、待機、クリック、スクロール、API確認などが必要になります。

Q4. リアルタイムで取得するほどよいのでしょうか?

必ずしもそうではありません。取得頻度を上げすぎると失敗率や負荷が増えることがあります。実務では、必要な鮮度と安定性のバランスを取ることが重要です。

まとめ

リアルタイムデータ取得とは、更新頻度の高いWeb情報を、できるだけ遅れなく継続的に収集し、監視・分析・意思決定に活用するための仕組みです。

ただし、最近のWebサイトは動的ページ化が進んでおり、Ajax通信やJavaScript描画、無限スクロールなどの影響で、従来の単純な取得方法では対応しにくくなっています。

そのため、重要なのは次の3点です。

- そのページがどのようにデータを表示しているかを見極めること

- リアルタイム性よりも、まず安定取得できる設計にすること

- API、自作、ツールのどれが適切かを要件に応じて選ぶこと

動的WebサイトやAjaxページからのデータ取得を安定して運用したい場合は、対象ページの構造を確認したうえで、適切な手法と設定を選ぶことが成功の鍵になります。

競合情報も営業リストも、ウェブデータをそのままExcel・CSV・Google Sheetsに出力

コード不要、誰でも今日から。クリック操作だけで必要な項目を自動抽出

Google Maps・食べログ・iタウンページ向けテンプレートで、リード獲得をすぐに開始

クラウドで毎日・毎週自動実行。大量取得でも安定して、競合動向を常に把握

MCP対応でAIエージェントと連携。収集データをAIに渡して分析・活用まで一気通貫

クレジットカード不要で無料スタート。世界600万人以上が選んだ信頼のツール