「企業の採用情報を効率的に収集したい!」「求人サイトの情報を毎回チェックするのは面倒・・・。」このような悩みを抱えていませんか。人材会社の営業担当者にとって、求人情報を効率的に収集することは、営業活動を効率的に進めるうえで非常に重要です。

しかし、膨大な情報の中から必要なデータを手作業で集めるのは時間と労力がかかります。そこで今回は、無料で利用できるツールを活用し、効果的に求人情報を収集するノウハウを解説します。これから紹介する手法を活用すれば、最新の求人情報を迅速に取得し、営業活動における生産性を大幅に向上させることができます。

求人サイト情報収集の基本

人材紹介会社や求人広告会社の営業担当者にとって、企業の求人情報を効率的に収集することは、企業の採用ニーズを素早く発見し、質の高いアプローチを図るうえで非常に重要です。ここでは、基本的な情報収集の方法とその重要性について解説します。

なぜ情報収集が必要か

求人情報の効率的な収集は、営業活動の効果を最大化するための鍵となります。企業がどの職種を募集しているかを把握することで、タイムリーなアプローチが可能になり、クライアント企業からの信頼も得られやすくなります。

また、求職者に対しても最新の情報を提供できるため、満足度の向上につながります。既存の求人サイトからの情報収集は、迅速かつ効率的に市場のニーズを把握するための有効な手段です。

収集すべき求人情報の内容

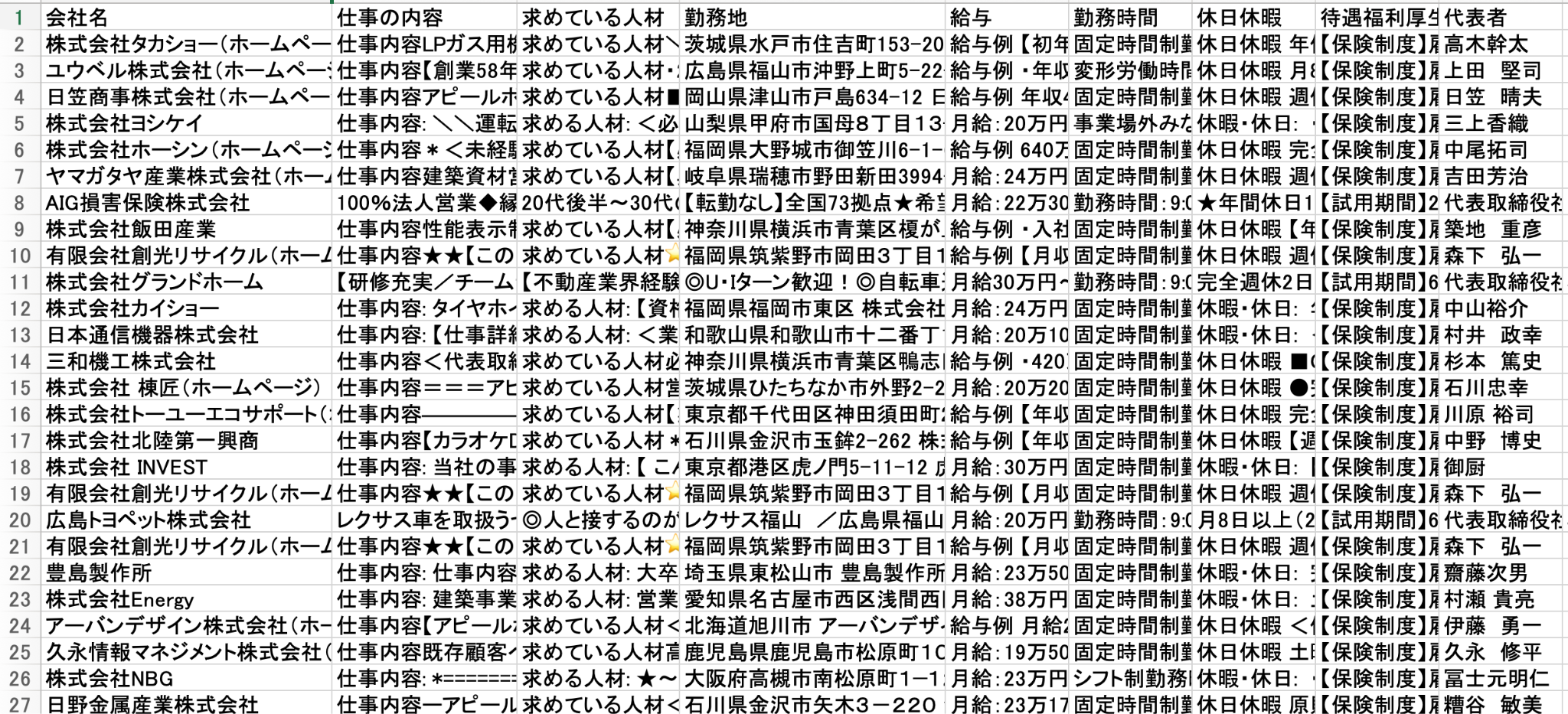

人材会社の営業担当者が収集すべき求人情報の内容は多岐にわたります。なるべく詳細に情報を収集することで、提案内容や仮説立てなど事前準備に役立てることが可能です。特に収集すべき求人情報の内容は次のとおりです。

- 企業情報

- 企業名

- 所在地、連絡先

- 理念・ビジョン

- 職種情報

- 職種名

- 仕事内容

- 必要なスキルや資格

- 雇用条件

- 雇用形態

- 給与

- 待遇・福利厚生

- 勤務時間・休日休暇

- 勤務地

求人サイト情報を収集する際の注意点

求人情報を効率的に収集することは非常に重要ですが、その際にはいくつかの注意点を考慮する必要があります。正確で最新の情報を維持し、信頼性の高いデータを提供するために、以下のポイントに留意しましょう。

定期的に情報を更新する

求人情報は常に変化しているため、定期的に情報を更新することが不可欠です。例えば、収集した情報が数ヶ月前のものであった場合、企業側ですでに採用ニーズがなくなっている可能性があります。

少なくとも1ヶ月に1度は、最新情報に更新し、常に新鮮な情報をストックしている状態を保つべきです。ただし、手作業で情報収集を行う場合、情報のチェックや更新は容易ではありません。後述しますが、スクレイピングツールを利用するなどして、情報収集プロセスの自動化を検討すべきでしょう。

収集した情報を整理する

収集した求人情報を適切に管理し、整理することは非常に重要です。情報が整理されていない場合、営業活動の効率が低下します。データベースを活用して情報を体系的に整理し、必要な情報を迅速に検索・取得できるようにしましょう。また、個人情報の取り扱いには細心の注意を払い、法令を遵守してデータ保護を徹底することが求められます。

情報収集プロセスを自動化する

求人情報を効率的に収集するためには、役立つウェブサイトやツールを活用することが重要です。例えば、OctoparseのようなWebスクレイピングツールを使用すれば、自動的にデータを収集し、手作業による負担を大幅に軽減できます。

さらに、Googleアラートを設定することで、新しい求人情報が掲載された際に通知を受け取り、最新の情報を常にキャッチアップできます。これらのツールを効果的に活用することで、効率的な情報収集を実現しましょう。

求人情報を収集する情報源(ソース)

近年、インターネットの普及や人材採用難により、企業はあらゆる手段で採用活動を行っています。求人募集が出ている=採用ニーズがあるということなので、人材会社の営業としては顧客開拓の参考になるでしょう。

しかし、具体的にどういった情報源があるのか、あるいはどれを活用すれば良いかわからない方も多いでしょう。ここでは、主な求人情報源を紹介します。

企業の採用ページ

企業が自社サイト内に掲載している採用ページは、最新の求人情報を提供する信頼性の高い情報源です。企業のミッションや求める人物像、雇用条件などの詳細情報が含まれており、営業活動の際に有効に活用できます。

求人広告メディア

リクナビNEXT、マイナビ、Dodaなど、求人情報を専門に扱う求人広告メディアは、鮮度の高い求人情報を提供します。大手求人広告メディアでは、多様な求人情報を得ることができ、クライアント企業に対する提案の幅を広げます。

求人検索エンジン

Indeedや求人ボックス、スタンバイなどの求人検索エンジンは、多数の企業の求人情報を一元的に検索・収集できるツールです。業種や職種を問わず、幅広い求人情報を提供し、効率的な営業活動を支援します。

SNS(ソーシャル・ネットワーキング・サービス)

FacebookやLinkedInなどのSNSは、企業が求人情報を掲載する場としても活用されています。SNSを利用することで、リアルタイムな求人情報を収集でき、迅速な対応が可能となります。

求人情報収集はWebスクレイピングがおすすめ

最新情報の更新は手作業で行うこともできますが、時間と労力がかかります。そこでおすすめの方法が、Webスクレイピングです。

Webスクレイピングとは、インターネット上の情報を自動的に収集するコンピュータ技術のことです。アグリゲーターには、Webスクレイピングが用いられています。

Webスクレイピングを求人サイトに活用すれば、より簡単に求人情報を収集できます。そうすれば、求人の傾向を分析したり、競合他社を追跡したり、求人を掲載してくれる企業のリードを集められるでしょう。

Webスクレイピングを活用する際の課題

Webスクレイピングを活用する際には、いくつかの課題を考慮する必要があります。これらの課題を解決することで、効率的かつ効果的に求人情報の収集が可能になります。

多くのサイトからスクレイピングする必要がある

求人メディアを立ち上げるためには、できるだけ多くのデータソースから情報をスクレイピングする必要があります。しかし、複数のソースからデータを収集するためには、高負荷な処理を実行するための最適なWebクローラーを構築する必要があります。

求人サイトの頻繁な更新についていく必要がある

大手求人サイトは日々更新されており、常に最新情報を収集するためには定期的にWebクローラーを起動する必要があります。しかし、最新情報を手に入れることは容易ではなく、タイムリーな更新が求められます。

膨大なデータのスクレイピングには時間がかかる

求人検索エンジンには何万件もの求人情報が掲載されており、これらの膨大なデータを収集するには非常に時間がかかります。さらに、膨大なデータを収集するとWebクローラーのパフォーマンスが低下する可能性もあります。

データを統合する必要がある

Webスクレイピングで収集したデータを求人サイトのデータベースに統合することも重要な作業です。しかし、データベースの統合には専門知識が必要な場合が多く、専門家の助けを借りることも検討する必要があります。

求人サイトのWebスクレイピング課題はOctoparseで解決可能

求人サイトの求人データをWebスクレイピングを使って収集するには、乗り越えるべき課題があります。それらを解決しないままでは、Webスクレイピングの展開は困難です。

そこで役立つのが、WebスクレイピングツールOctoparse(オクトパス)です。Octoparseは、誰でもかんたんにWebスクレイピングを活用できるクラウドサービスです。Webスクレイピングを行う上で起こり得るさまざまな課題を解決できる、便利な機能を備えています。

Octoparseの特徴

Octoparseはプログラミングのスキルがない方でも簡単にWebスクレイピングを行えるツールです。ここでは、Octoparseの特徴的な機能をご紹介します。

初心者でも安心のスクレイピングテンプレート

Octoparseでは数多くのスクレイピングテンプレートが用意されています。リクナビNEXTやIndeed、Linkedinなどといった人気Webサイトのテンプレートがあり、それらのテンプレートを用いれば、わずかな操作だけで対象のサイトから求人情報を抽出できます。

https://www.octoparse.jp/template/haken-rikunabi-job-listings-scraper

定期的なデータ抽出に最適のスケジュール設定機能

Octoparseではスケジュール設定も可能なので、スクレイピングを実行する対象サイトURL・日付・時刻などを指定することで、データ抽出の自動化が可能です。常に最新情報の収集が必要な求人サイトにおいては、スケジューリング設定は非常に重宝する機能といえます。

膨大なデータを高速で抽出するクラウド抽出機能

データ量が膨大な求人サイトのデータ収集を行う場合は、Octoparseのクラウド抽出機能が役立ちます。クラウド抽出はローカル抽出に比べ、より高速でデータのスクレイピングが可能です。

さらに、収集したデータはクラウド上に保存され、その後はいつでもデータにアクセスできるようになります。

リクナビのテンプレート使い方

Octoparseを使ってリクナビNEXTから求人情報を取得する手順は以下の通りです。この方法を活用すれば、リクナビNEXTから自動的に最新の求人情報を収集し、求人サイトの内容を充実させることができます。

https://www.octoparse.jp/template/rikunabi-next-job-scraper

手順1: Octoparseのダウンロードとセットアップ

まず、Octoparseをダウンロードしてインストールします。サービスを立ち上げ、アカウントを作成してログインします。

手順2: テンプレートの選択

Octoparseのトップページにある「テンプレートギャラリー」に移動し、リクナビNEXTのテンプレート(プリセットクローラー)を選択します。このテンプレートは、リクナビNEXTに特化したスクレイピング設定があらかじめ用意されています。

手順3: パラメーターの設定

テンプレート内で以下のパラメーターを設定します。

- キーワード:抽出したい求人情報のキーワードを入力します(例: 「エンジニア」、「営業」など)

- タスク名: 任意でタスク名を入力します。(例:エンジニア_20240701)

手順4: 実行とデータ抽出

パラメーターの設定が完了したら、「実行」をクリックし、スクレイピングを開始します。「クラウド抽出」オプションを選択すると、データがクラウド上で抽出され、数分後には結果が表示されます。

手順5: データの確認とエクスポート

抽出されたデータは、Octoparseのダッシュボードから確認できます。必要に応じてデータを整理し、ExcelやCSVなどの形式でエクスポートします。

このように、Octoparseのテンプレートを利用することで、リクナビNEXTから手軽に最新の求人情報を取得することが可能です。時間と労力を大幅に節約できるため、サイトの更新頻度を高め、ユーザーにとって有益な情報を常に提供できます。

まとめ

今回は、人材会社の営業担当者が企業の求人情報を効率的に収集するための方法について詳述しました。情報の鮮度を保ち、クライアント企業に対して信頼性の高いデータを提供することは、営業活動において非常に重要です。

これにより、クライアント企業との関係を強化し、求職者とのマッチング精度を向上させることができます。これらの手法を駆使することで、効果的なリード獲得を目指し、ビジネスの成功につなげましょう。