「競合サイトの価格を毎日チェックしたいけど、コピペで1時間かかる」「PythonやHTMLなんて分からない」——そんな方に朗報です。2026年、AIとWebスクレイピングの融合によって、プログラミングの知識がなくてもWebデータの自動収集が驚くほど簡単になりました。

ChatGPTやGeminiに「このサイトの情報をまとめて」とお願いするだけでデータが整理される時代。さらに進んで、AIがWebサイトの構造を自動解析し、定期的にデータを取得し続けてくれるツールも登場しています。

本記事では、AIを活用したWebスクレイピングの3つのレベル——手動AI活用、ノーコードツール、AIエージェント——を段階的に解説します。「まず今日から試せること」から「本格的な業務自動化」まで、あなたのスキルと目的に合った方法が見つかるはずです。

そもそもAIスクレイピングとは?従来手法との違い

AIスクレイピングとは、人工知能(AI)を活用してWebサイトからデータを自動的に抽出する技術のことです。

従来のWebスクレイピングでは、対象ページのHTML構造を分析し、CSSセレクタやXPathといった「住所」のような指定方法で取得対象を手動設定する必要がありました。これにはHTMLの知識が必須で、サイトのデザインが少し変わるだけでルールが壊れてしまうという課題がありました。

一方、AIを搭載したスクレイピングでは、大規模言語モデル(LLM)や機械学習がページの内容を意味レベルで理解します。「これは商品名」「これは価格」「これはレビュー」といった判断を、HTMLの構造に依存せずに行えるのです。

この違いを簡潔に整理すると、次のようになります。

従来型のWebスクレイピングは、ルールベースの抽出であり、サイト構造の変更に弱く、設定にはHTMLやXPathの知識が必要でした。サイトがリニューアルされるたびにメンテナンスが発生し、保守コストが高い傾向にあります。

AIスクレイピングは、文脈理解ベースの抽出です。サイトのレイアウトが変わっても、AIが「この情報が商品名だ」という意味を読み取って対応します。設定には専門知識が不要で、自然言語での指示やワンクリック操作で完了するケースも増えています。

Webスクレイピング市場全体も急成長を続けており、2030年には20億ドル規模に達するとの予測もあります。その成長を牽引しているのが、まさにAI技術の統合です。

AIがWebスクレイピングを変えた3つのポイント

ポイント1:プログラミング不要でデータ収集が可能に

かつてWebスクレイピングは、PythonやBeautifulSoup、Seleniumなどの知識を持つエンジニアだけの領域でした。しかし2026年現在、ChatGPT・Gemini・ClaudeといったAIに日本語でお願いするだけで、Webページの情報を構造化されたデータとして取得できます。

たとえば「このURLのページから、商品名と価格の一覧を表形式でまとめて」とプロンプトを入力するだけで、AIが数秒でデータを整理してくれます。

ポイント2:サイト構造の変化に自動対応

従来のスクレイピングで最大のストレスだったのが、対象サイトのHTML構造が変わるたびにルールを修正する保守作業でした。AIスクレイピングでは、LLMがページの内容を意味で理解するため、レイアウトが変更されても多くの場合は自動で追従します。

これにより、スクレイピングの「壊れやすさ」が劇的に改善され、運用コストの削減につながっています。

ポイント3:抽出だけでなく「分析」まで一気通貫

AIスクレイピングの真の強みは、データ取得後の処理にあります。従来は「データを集めて→加工して→分析する」という3ステップが必要でしたが、AIを使えば取得と同時に分類、要約、翻訳、感情分析までワンストップで処理できます。

たとえば、競合サイトのレビュー100件を取得し、「ポジティブ・ネガティブに分類して、主な不満ポイントを3つにまとめて」という指示まで一度に実行可能です。

【レベル1】ChatGPT・GeminiでAIスクレイピングを体験する

まず最も手軽にAIスクレイピングを体験する方法は、ChatGPTやGoogle Gemini、Claude といったAIチャットサービスを直接使う方法です。

方法A:HTMLソースをコピーしてAIに貼り付ける

最もシンプルな手順は次のとおりです。

ステップ1: ブラウザで対象のWebページを開き、右クリック→「ページのソースを表示」でHTMLソースコードを表示する。

ステップ2: HTMLソース全体を選択してコピーする。

ステップ3: AIチャット(Gemini、ChatGPT等)の入力欄に貼り付けて、次のようにお願いする。

「以下のHTMLから、○○のデータを抽出して表形式でまとめてください」

多くの場合、AIは数秒で構造化された表を返してくれます。

方法B:URLを直接指定してAIに取得させる

一部のAIサービス(特にGemini)では、URLを直接指定してWebページの内容を取得・分析することも可能です。

ただし、AIサービスによってはWebアクセス機能に制限がある場合もあります。また、動的に生成されるページ(JavaScript依存のSPA等)では正確に取得できないケースもあるため、結果の確認は必ず行いましょう。

レベル1の限界

この方法は手軽な反面、いくつかの限界があります。毎回手動でプロンプトを実行する必要があること、大量のページを一括処理するには不向きなこと、そしてスケジュール実行(定期的な自動取得)ができないことです。

「もっと楽をしたい」「定期的に自動で取得し続けたい」と感じたら、次のレベルに進む時です。

【レベル2】ノーコードツールでAIスクレイピングを自動化する

レベル1の「毎回手動」という課題を解決するのが、AI機能を搭載したノーコードのWebスクレイピングツールです。

Octoparse:AI自動識別で設定不要のスクレイピング

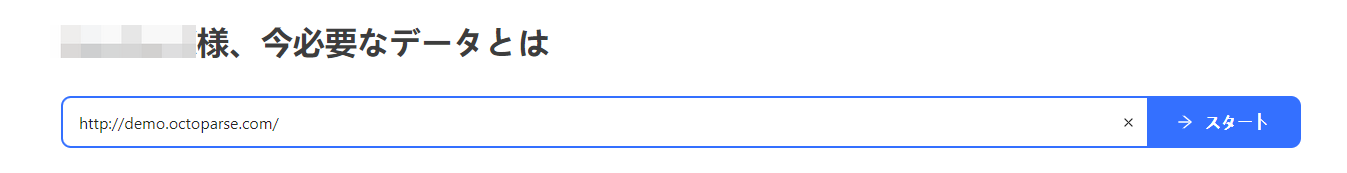

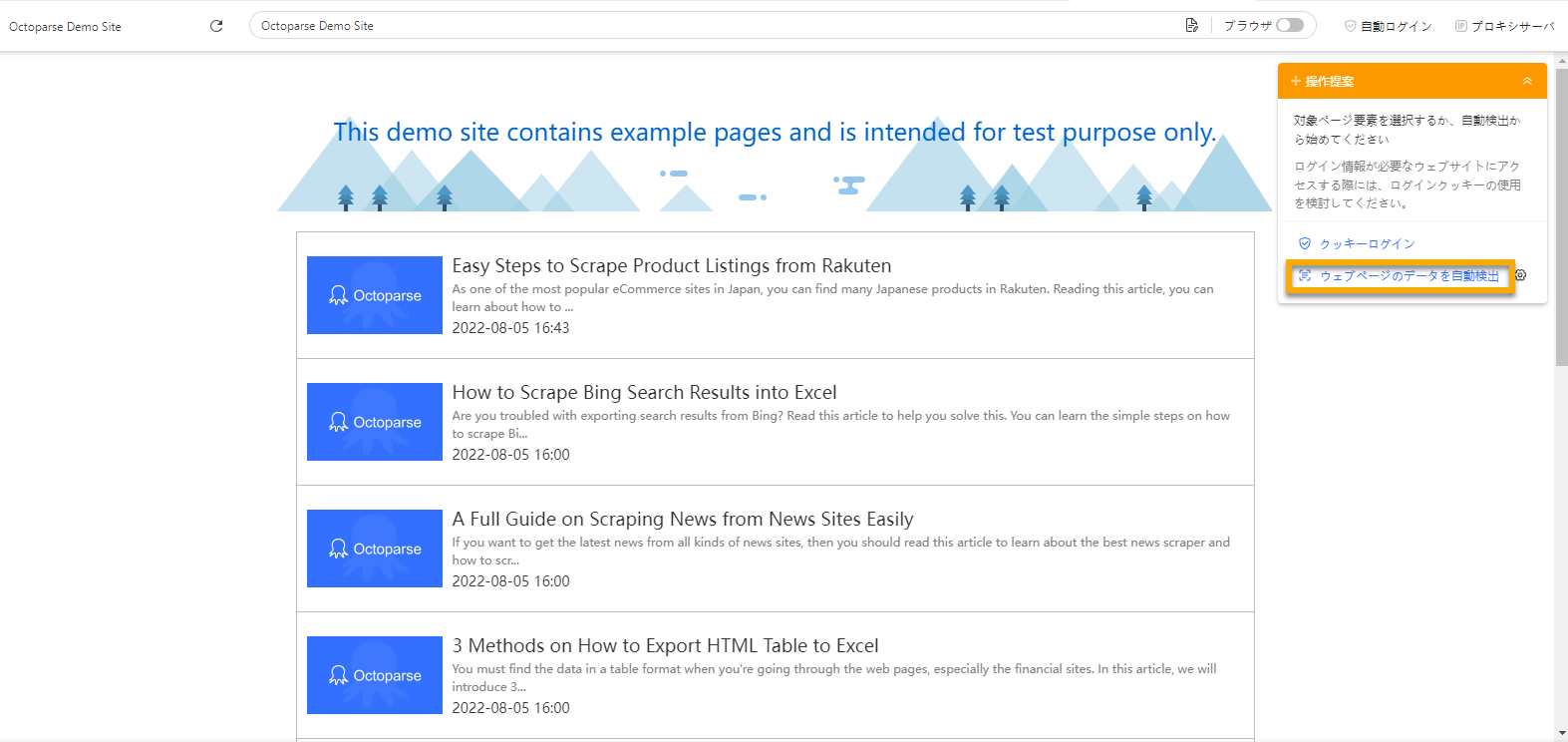

Octoparseは、URLを入力するだけでWebページの構造をAIが自動解析し、取得すべきデータを自動検出するクラウド型ツールです。

具体的な操作手順は次のとおりです。

ステップ1: OctoparseにスクレイピングしたいページのURLを入力する。

ステップ2: 「Webページを自動識別する」をクリック。AIがページ上のデータ構造を解析し、商品名・価格・画像URL等を自動で検出する。

ステップ3: プレビューで取得データを確認し、問題なければ「ワークフローを生成」をクリック。

ステップ4: 「実行」ボタンでスクレイピングを開始。完了後、CSV・Excel・JSONなどの形式でデータをエクスポート。

レベル1との最大の違いは、スケジュール実行が可能な点です。「毎朝9時に競合10社の価格を自動取得して、スプレッドシートに保存する」といった運用が、PCの電源を切っていても実行できます。

さらに、Octoparseには主要サイト向けのスクレイピングテンプレートが用意されています。Amazon、楽天、Googleマップ、Google検索結果、X(旧Twitter)など、頻繁にスクレイピングされるサイトについては、パラメータを入力するだけで設定が完了します。

レベル1(手動AI) vs レベル2(ノーコードツール)の比較:

レベル1の手動AI活用は、初期コストゼロで今すぐ試せる手軽さが魅力ですが、毎回手動操作が必要で、大量ページの一括処理やスケジュール実行には不向きです。レベル2のノーコードツールは、初回設定だけで済み、以降はスケジュール実行で完全自動化できます。IPローテーションやページネーション自動処理など、運用に必要な機能も揃っています。

【レベル3】AIエージェントによる自律型データ収集

2026年、AIスクレイピングの最前線に位置するのがAIエージェントによるデータ収集です。

従来のAIスクレイピング(レベル1・2)は、「人間が指示を出し、AIが実行する」という構図でした。しかし、AIエージェントは目標を与えるだけで、データの探索・取得・整理・分析までを自律的に判断して実行します。

MCP(Model Context Protocol)とは

この自律型データ取得を支える技術の一つが、MCP(Model Context Protocol)です。MCPは、AIモデルが外部のツールやデータソースと標準化されたプロトコルで接続するための仕組みです。

OctoparseもMCP AI機能を提供しており、AIエージェントがOctoparseのスクレイピング能力を直接呼び出してデータを取得できる環境を実現しています。これにより、「市場の最新トレンドを調べて、競合3社の新商品情報をまとめて、価格比較表を作成して」といった複合的な指示も、AIエージェントが自律的に処理できます。

AIエージェント時代に求められるスキル

AIエージェントが自律的にデータを収集する時代になっても、人間が担うべき役割があります。それは「何を取得すべきか」という目標設定と、「取得データをどうビジネスに活かすか」という戦略思考です。

データ収集の作業自体はAIに任せ、人間はより上位の意思決定に集中できるようになる——これが、AIスクレイピングがもたらすビジネスの変化の本質です。

AIスクレイピングの活用シーン5選

AIとWebスクレイピングを組み合わせることで、どのような業務が効率化できるのか。代表的な5つのシーンを紹介します。

シーン1:EC・競合サイトの価格モニタリング

競合商品の価格を毎日自動で取得し、自社の価格戦略に反映。AIで価格変動のパターンを分析し、最適な値付けタイミングを予測することも可能です。

シーン2:営業リスト・リードジェネレーション

Googleマップや業界ポータルサイトから企業情報を自動収集し、営業リストを作成。AIが企業規模や業種を自動分類するため、ターゲティングの精度が向上します。

シーン3:SNS・口コミの感情分析

X(旧Twitter)や口コミサイトから投稿を自動収集し、AIで感情分析を実施。自社ブランドに対するポジティブ・ネガティブな反応をリアルタイムで把握できます。

シーン4:求人・採用市場の動向調査

求人サイトから特定の職種・地域の求人情報を自動収集し、給与レンジや求人数のトレンドを分析。採用戦略の見直しや、人材マーケットの動向把握に活用できます。

シーン5:AI学習データの収集

大規模言語モデルやカスタムAIモデルのトレーニングには、大量のテキストデータが必要です。Webスクレイピングは、こうしたAI学習用データセットの構築においても重要な役割を果たしています。

AI×Webスクレイピングの法的・倫理的な注意点

AIスクレイピングは強力な技術ですが、利用にあたっては法的・倫理的なルールの遵守が不可欠です。

robots.txtと利用規約の確認

Webスクレイピングを実行する前に、対象サイトのrobots.txtと利用規約を必ず確認しましょう。サイトによっては、自動アクセスやデータ取得を明確に禁止している場合があります。

サーバーへの負荷配慮

短時間に大量のリクエストを送ると、対象サイトのサーバーに過度な負荷をかけ、業務妨害とみなされる可能性があります。リクエスト間隔は最低でも1秒以上空け、大規模な取得を行う場合はさらに余裕を持たせましょう。

AI生成コンテンツの著作権

AIが取得したデータをそのまま公開・配布する場合は、著作権法に注意が必要です。取得データの加工・分析結果を活用するのは一般的に問題ありませんが、原文をそのまま転載する行為は著作権侵害に該当する可能性があります。

個人情報の取り扱い

氏名、メールアドレス、電話番号など個人を特定できる情報をスクレイピングで収集する場合は、個人情報保護法に基づいた適切な管理が必要です。特に2025年に改正された個人情報保護法では、Web上の公開情報であっても取り扱いに注意が求められています。

参考:スクレイピングは違法?Webスクレイピングに関するよくある誤解

よくある質問(FAQ)

Q1. AIスクレイピングにプログラミング知識は必要ですか?

いいえ、2026年現在は不要です。ChatGPTやGeminiに日本語で依頼するだけでデータ取得が可能ですし、Octoparseのようなノーコードツールを使えば、設定から定期実行までプログラミングなしで完結します。Pythonの知識があればより高度なカスタマイズも可能ですが、必須ではありません。

Q2. ChatGPTとスクレイピング専用ツール、どちらがいいですか?

目的によります。少量のデータを今すぐ取得したいならChatGPTやGeminiが手軽です。一方、定期的に大量のデータを自動取得し続けたい場合は、Octoparseのようなスケジュール実行対応のツールが適しています。まずはAIチャットで試して、必要に応じてツールに移行するのがおすすめです。

Q3. AIスクレイピングは動的サイト(SPA)にも対応できますか?

AIチャットサービス(Gemini等)でURLを直接指定する方法では、JavaScriptで動的に生成されるコンテンツの取得に制限がある場合があります。Octoparseのような専用ツールは、ブラウザレンダリング機能を内蔵しているため、動的サイトからのデータ取得にも対応しています。

Q4. AIスクレイピングの精度はどのくらいですか?

AIによるデータ取得の精度は年々向上しており、構造化されたページ(ECサイトの商品一覧、テーブルデータ等)では95%以上の精度を実現しているケースも多いです。ただし、非定型的なレイアウトや画像内のテキストなどでは誤抽出が起こる場合もあるため、初回は必ず取得結果を目視確認しましょう。

Q5. 無料でAIスクレイピングを試すことはできますか?

はい。ChatGPTやGoogle Geminiは無料プランでもWebデータの整理に使えます。また、Octoparseには無料プラン(10タスクまで)と14日間の無料トライアルが用意されているため、コストをかけずにAIスクレイピングの実力を試すことが可能です。

まとめ:AIスクレイピングは「できるかどうか」ではなく「いつ始めるか」

正直に言うと、この記事を書いている筆者自身も、2年前まではWebスクレイピングに対して「エンジニアの仕事でしょ」という先入観を持っていました。PythonもHTMLも分からないし、自分には関係ない世界だと思っていたのです。

それが、ChatGPTに「このページの情報をまとめて」と聞いてみた瞬間に、認識が一変しました。ものの10秒で、手作業なら30分はかかるデータが整然とした表になって返ってきたのです。

そこから「もっと楽をしたい」という欲が出て、Octoparseのようなツールでスケジュール実行を試し、今では毎朝自動でデータが更新される仕組みが動いています。

2026年のAIスクレイピングは、もはや「できるかどうか」の問題ではありません。「いつ始めるか」の問題です。毎日30分のコピペ作業を、来月も再来月も続けるのか。それとも今日、AIに一度お願いして、その時間を分析や企画に使うのか。

まずは今お使いのAIチャットに、「このサイトの情報をまとめて」と話しかけてみてください。きっと、「もっと早く知りたかった」と思うはずです。

AIスクレイピングを本格的に始めるなら → Octoparse 無料ダウンロード

関連記事:

- スクレイピングは違法?Webスクレイピングに関するよくある誤解

- 【2026年版】スクレイピングツール12選!無料&AI対応を比較

- Octoparse MCP AI

- スクレイピングにおける10の課題と対策

- GoogleスプレッドシートでWebデータをスクレイピングする

- 【2026年最新】Chrome拡張機能おすすめスクレイピングツール5選