Webサイト上の情報を自動で取得したいと考えたとき、まず候補に挙がるのがPythonです。

中でも Selenium は、ブラウザを実際に操作しながらデータを取得できるため、動的ページの取得にも対応しやすく、Webクローラーの入門としてよく使われています。

本記事では、PythonでWebクローラーを作ってみたい方に向けて、Seleniumの基本的な使い方と、実際にページ情報を取得する流れをわかりやすく解説します。

あわせて、どのようなケースでPython開発が向いているのか、逆にコードを書かずに進めたほうが効率的な場面はどこかも紹介します。

PythonでWebクローラーを作る前に知っておきたいこと

まず整理しておきたいのが、「Webクローラー」と「Webスクレイピング」は似ているようで少し役割が異なるという点です。

Webクローラーは、Webページを巡回して情報を収集する仕組み全体を指すことが多く、

Webスクレイピングは、その中でもページから必要なデータを抽出する処理を指します。

たとえば、複数ページをたどって商品名や価格を集める場合は、

「ページを巡回する」部分がクローラー、

「商品名・価格を取り出す」部分がスクレイピング、というイメージです。

Pythonを使えば、この一連の流れを自動化できます。

必要な開発環境

PythonでSeleniumを使ったWebクローラーを作るには、事前にいくつかの環境を整えておく必要があります。

まずは Python 本体をインストールし、そのうえで Selenium を利用できる状態にします。

ページ内容の解析を補助するために BeautifulSoup を組み合わせることも多く、取得したデータをCSVに保存する場合は csv モジュールを使います。

また、Seleniumはブラウザを自動操作する仕組みのため、Chromeなどのブラウザ本体と、それに対応するWebDriverの準備も必要です。

インストール例

ここまで整えば、基本的なクローラーを動かす準備は完了です。

Seleniumとは?

Seleniumは、ブラウザ操作を自動化するためのライブラリです。

指定したURLを開く、検索ボックスに文字を入力する、ボタンをクリックする、ページが読み込まれるまで待つ、といった一連の操作をコードで再現できます。

そのため、静的なHTMLを読むだけでは取得しにくいページでも、実際のブラウザ表示をもとに処理できるのが大きな特徴です。

特に、以下のようなページではSeleniumが役立ちます。

• JavaScriptで内容が後から表示されるページ

• ボタンをクリックすると情報が切り替わるページ

• ログインや検索操作が必要なページ

一方で、処理速度は比較的遅く、コードの保守も必要になるため、

「とにかく手早くデータを取りたい」という用途では、別の方法のほうが向いていることもあります。

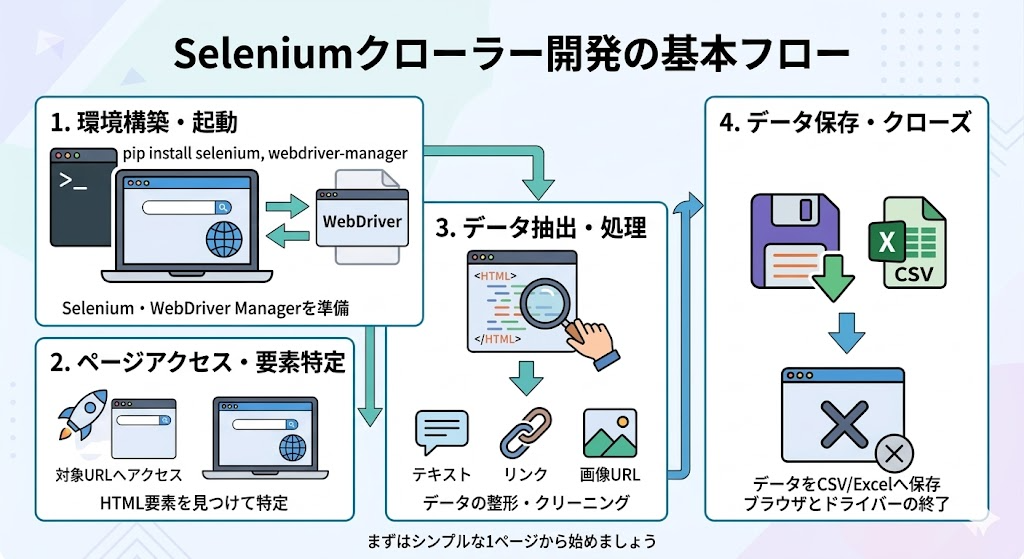

SeleniumでWebクローラーを作る基本手順

Seleniumを使ったクローラー開発の流れは、基本的にはそれほど複雑ではありません。

まずブラウザを起動し、対象ページを開きます。

次に、取得したい要素を指定して、必要なテキストやリンクを取り出します。

最後に、取得したデータをCSVなどに保存すれば、ひと通りの処理は完成です。

最初はシンプルな1ページの取得から始め、慣れてきたらページ送りや複数URLへの対応を追加していくのがおすすめです

サンプルコード:ページ情報を取得してみる

以下は、Seleniumでページを開き、指定した要素のテキストを取得するシンプルな例です。

このコードでは、まずブラウザを起動して Python公式サイト を開き、そのページ内の h1 要素を取得して表示しています。もちろん、実際の業務では商品名や価格、レビュー件数、店舗名などを取得したいケースが多いと思いますが、基本的な考え方は同じです。まずは「ページを開く」「要素を見つける」「中身を取り出す」という流れを理解することが重要です。

よくあるつまずき

Pythonでクローラーを作り始めると、最初にぶつかりやすいポイントがいくつかあります。

要素が見つからない

ページ構造が変わっていたり、指定したセレクタが正しくないと、要素を取得できません。

まずはブラウザの開発者ツールで対象要素を確認し直すことが大切です。

ページの読み込みが間に合わない

動的ページでは、表示前に要素を取りに行くと失敗します。

その場合は、待機処理を入れてから取得する必要があります。

サイト側の仕様変更

Seleniumで動いていたコードも、サイト側のレイアウト変更で急に動かなくなることがあります。

実運用では、定期的なメンテナンスを前提に考える必要があります。

このように、Pythonでの開発は柔軟性が高い一方で、継続的な調整が必要になりやすい点も理解しておきたいところです。

Pythonでの開発が向いている人・向いていない人

Pythonでクローラーを作る方法は、細かくカスタマイズしたい場合や、処理ロジックを自分で制御したい場合に向いています。

すでにPythonの基礎知識がある方や、社内にエンジニアがいる場合には、かなり有力な選択肢です。

一方で、次のような方には負担が大きくなりがちです。

- できるだけ早くデータ取得を始めたい

- コードの保守に時間をかけたくない

- 非エンジニアでも扱える方法を探している

その場合は、最初からノーコードツールを使ったほうが、結果的に早く業務に乗せられることも少なくありません。

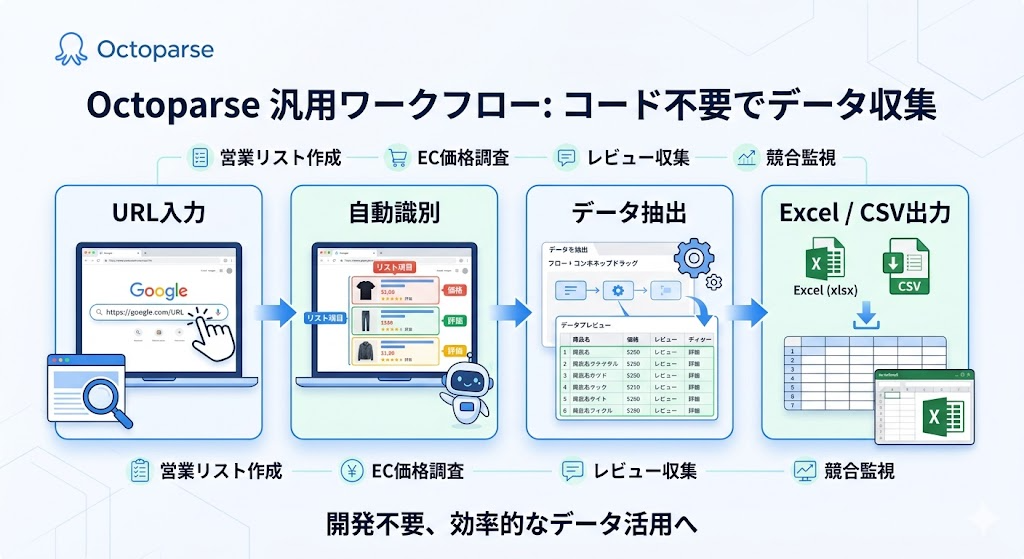

コード不要で始めたいなら、Octoparseという選択肢もある

もし「Pythonを書くのはハードルが高い」「まずは動く形で早く試したい」と感じる場合は、

ノーコードで使えるスクレイピングツールを選ぶ方法もあります。

Octoparse なら、取得したいページのURLを入力し、ページ上のデータを自動識別したうえで、そのまま抽出フローを作成できます。

クリックやページ送り、スクロールなども画面上で設定できるため、コードを書かずにデータ取得を始めたい方には使いやすい選択肢です。

特に、営業リスト作成、EC価格調査、レビュー収集、競合監視など、

「まずデータ収集を業務で回したい」ケースでは、開発よりも運用のしやすさが重要になることも多いでしょう。

その場合、最初からツールを使うほうが効率的です。

まとめ

PythonとSeleniumを使えば、Webクローラーを自作することは十分可能です。

ページを開き、必要な要素を取得し、データを保存するという基本の流れを押さえれば、まずはシンプルなクローラーから始められます。

ただし、実務で継続的に使う場合は、ページ構造の変更や待機処理、保守コストまで含めて考える必要があります。

柔軟性を重視するならPython、

スピードと運用のしやすさを重視するならノーコードツール、という形で選ぶのがおすすめです。

Pythonでまず仕組みを理解したうえで、自分に合った方法を選ぶと、データ収集をより実用的に進めやすくなります。