近年、ビッグデータ分析に用いるデータ収集のために、Webスクレイピングを利用するケースが増えています。

Webスクレイピングは、Web上の情報を自動で収集し、分析や業務効率化に活用できる技術です。一方で、「違法ではないのか」「利用規約に反しないのか」「AIでどこまで自動化できるのか」など、不安や疑問を持つ方も少なくありません。

そこで本記事では、Webスクレイピングについてよくある20の質問に、2026年時点で押さえておきたい考え方を踏まえてわかりやすく回答します。なお、本記事は一般的な情報提供を目的としており、個別案件の法的判断を行うものではありません。

1.そもそも Webスクレイピングとは何か?

Webスクレイピングは、Webデータ抽出とも呼ばれ、Webページ上の情報を自動で取得し、必要な形に整理して活用するための技術です。一般的には、HTTPリクエストを送信してページデータを取得したり、Webブラウザを自動操作して表示内容を解析したりすることで行われます。収集したデータは、ビジネス分析、競合調査、価格モニタリング、マーケティング施策の立案などに活用されます。

具体的な手法としては、ページのHTMLや動的に生成される表示内容、場合によってはAPIレスポンスなどを解析し、必要な情報を抽出します。スクレイピングツールやプログラムを使用することで、手作業よりも効率的に、一定のルールに基づいて大量のデータを収集できます。

関連記事: Webスクレイピングの始まりはいつ?これからどうなる?

2.Webスクレイピングができること

Webスクレイピングでは、価格・商品情報・求人情報・ニュース・公開プロフィールなど、公開ページ上の情報を継続的に収集できます。近年は、集めたデータをそのまま保存するだけでなく、AIで分類・要約・異常検知まで行う運用も増えています。

- 市場調査:競合他社の価格や製品情報を収集し、自社の優位性を活かした競争力のある戦略を立てる。

- データ分析:大量のデータを収集し、トレンド分析やパターン認識に役立てる。

- データモニタリング:ECサイトの価格変動を監視し、適切な価格設定やプロモーションを行う。

- データマイニング:インターネット上の公開データを利用して、新しいインサイト(洞察)を得る。

関連記事:Webスクレイピングとは?基本や仕組み、活用事例まで解説

3.Webクローリングとの違いは?

WebスクレイピングとWebクローリングは異なる技術ですが、互いに関連しています。

- Webスクレイピング:特定のWebページから必要なデータを抽出する技術。例えば、特定の商品情報や価格を収集する際に用いられます。

- Webクローリング:インターネット上の多くのWebページを自動的に巡回し、Webサイト全体のインデックスを作成する技術。検索エンジンがインターネット上のコンテンツを発見する際に使用されます。

わかりやすくいうと、Webスクレイピングは「収集したデータの質」に重点を置き、Webクローリングは「Webページの広範な収集」に重点を置くといった違いがあります。

4.Webスクレイピングはデータマイニング?

Webスクレイピングとデータマイニングは異なるプロセスですが、相互に補完し合うことができます。

- Webスクレイピング:インターネット上からデータを収集する技術。主にWebサイトのHTML構造を解析して、特定の情報を抽出します。

- データマイニング:収集された大量のデータからパターンやトレンドを見つけ出す技術。ビジネスインサイトの発見や意思決定の支援に役立ちます。

簡単にいえば、スクレイピングは「集める」、データマイニングは「分析して意味を見つける」工程です。実務では、スクレイピングで集めたデータを整形し、その後にBIやAIで分析する流れが一般的です。

関連記事:5分で分かる!ビッグデータ、機械学習、データマイニングの意味と比較

5.WebスクレイピングとAPIは同じ?

WebスクレイピングとAPI(アプリケーション・プログラミング・インターフェース)は、データを取得する際にアプローチが異なります。

- Webスクレイピング:WebページのHTMLや表示内容を解析し、必要な情報を抽出する方法です。特定のWebページ上に公開されている情報を取得する際に用いられますが、ページ構造や表示方法が変更されると、取得ロジックの修正やメンテナンスが必要になることがあります。

- API:提供者が定めた仕様に従って機能やデータへアクセスする仕組みです。データ形式やアクセス方法があらかじめ定義されていることが多く、利用条件や取得可能な範囲も比較的明確です。そのため、スクレイピングに比べて実装や運用が安定しやすい傾向があります。ただし、APIも仕様変更、レート制限、提供終了、プランによる利用制限などがあり得るため、常に万能とは限りません。

また、Webスクレイピングは、APIが提供されていない場合や、APIでは必要なデータを十分に取得できない場合にも有効です。そのため、取得したいデータに公式APIがある場合は、まずAPIで実現できるかを確認するのが一般的ですが、APIとWebスクレイピングは優劣の関係ではなく、それぞれ適した場面が異なる手法といえます。どちらを選ぶかは、必要なデータの種類、利用目的、更新頻度、利用条件、コストなどに応じて判断することが重要です。

6.Webスクレイピングは必ずコーディングが必要?

Webスクレイピングには、必ずしもコーディングが必要というわけではありません。スクレイピングを行う方法としては、主に次のようなものがあります。

- コーディングを伴うスクレイピング:PythonやJavaScriptなどのプログラミング言語を使って、用途に応じたスクレイピングスクリプトを作成する方法です。柔軟性が高く、高度なカスタマイズにも対応しやすいのが特徴です。

- ノーコードツールでのスクレイピング:プログ ラミングの知識があまりなくても使いやすいスクレイピングツールもあります。例えばOctoparseのようなノーコードツールでは、ドラッグ&ドロップやポイント&クリックのインターフェースを通じて、比較的簡単にスクレイピングタスクを設定できます。

実務では、まず対象サイトの構造や必要なデータを整理したうえで、比較的単純な案件はノーコードツールで対応し、複雑な案件や細かな制御が必要な場合は、コード実装やAPI連携を検討する、という切り分けが現実的です。

7.AI(人工知能)でWebスクレイピングを自動化できる?

可能です。実際、AIを活用してWebスクレイピングやその周辺業務を効率化するケースは増えています。たとえば、AIは次のような場面で役立ちます。

- データ収集・処理の効率化:抽出項目の推定、ノイズ除去、データ整形、分類、要約などを支援できます。これにより、収集後の処理を含めた全体の効率を高めやすくなります。

- 複雑なページへの対応支援:動的コンテンツや複雑なページ構造を持つサイトでは、ブラウザ自動化やAPI解析などの技術が中心になりますが、AIが抽出対象の特定やルール作成の補助に役立つ場合があります。

- 異常検知や保守の補助:取得結果の欠損、不自然な値、ページ構造の変化による抽出ミスなどを検知し、見直しが必要な箇所を見つけやすくできます。

このように、AIはWebスクレイピングの精度や効率の向上に役立ちます。

ただし、AIにすべてを任せればよいわけではありません。どの項目を取得するかの定義、取得結果の検証、利用条件やルールの確認は、人が責任を持って行う必要があります。

8.Web全体からデータを抽出できる?

公開されているWeb上の情報を広く収集することは可能ですが、Web全体を網羅的かつ継続的に抽出することは、現実には非常に困難です。その理由は次のとおりです。

- 多様なページ構造:Webサイトごとに構造、表示方法、更新頻度が異なるため、単一のツールやスクリプトだけであらゆるサイトに対応することは困難です。

- 技術的な制約:膨大なページを継続的に取得・保存・更新するには、大きな計算資源、通信帯域、ストレージ、保守体制が必要です。

- アクセス制限や利用条件:サイトによっては、利用規約、認証、レート制限、技術的な防御策などにより、自動取得が制限されている場合があります。

そのため、実務ではWeb全体を対象にするのではなく、目的に応じて対象サイトや対象ページを選定し、必要な範囲に絞ってデータを取得するのが一般的です。

関連記事:Webスクレイピングの活用方法は?実施時の知っておきたい注意点を詳しく解説!

9.ログインが必要なWebサイトからデータをスクレイピングできる?

技術的には可能です。利用規約、契約条件、アカウント権限の確認が先です。認証領域のデータ取得は公開情報の取得より慎重さが求められ、社内向け運用でも法務・情報セキュリティの確認を挟むべきです。一般的には、次のような流れで進めます。

- ログイン認証:スクレイピングスクリプトがログインページにアクセスし、ユーザー名とパスワードを入力して認証を行います。

- セッション管理:ログイン後のセッションを維持し、認証済みの状態でデータを抽出します。このためにクッキーやセッションIDを利用することが多いです。

- データ抽出:ログイン後にアクセス可能なページから必要なデータを抽出します。

ただし、このプロセスには、通常のスクレイピングに比べて追加の実装や運用上の注意が必要です。

10.動的に生成されるWebコンテンツからデータを抽出する方法はある?

あります。JavaScriptで描画されるページでは、レンダリング後のHTMLや表示内容を扱うか、ブラウザが裏側で行っている通信を確認するのが基本です。近年は静的HTMLだけでなく、XHRやFetch、GraphQL、WebSocketなどを見ながら設計するケースもあります。一般的には、次の方法が挙げられます。

- JavaScriptレンダリング:動的なコンテンツはJavaScriptによって生成されることが多いため、ヘッドレスブラウザ(例:PuppeteerやSelenium)を使用してページをレンダリングし、JavaScript実行後のHTMLや表示内容を取得します。

- APIの利用:一部のWebサイトでは、動的コンテンツの表示にAPI通信が使われています。その場合、ブラウザが取得しているデータを確認し、必要な情報を取得できることがあります。

- WebSocket:リアルタイム更新を伴うページでは、WebSocket通信が使われることがあります。その場合、通信内容を確認して必要なデータを取得できるケースもあります。

これらの手法を適切に使い分けることで、動的なWebページからデータを取得できる場合があります。

関連記事:リアルタイムデータ取得とは?動的Webサイトから自動収集する方法を解説

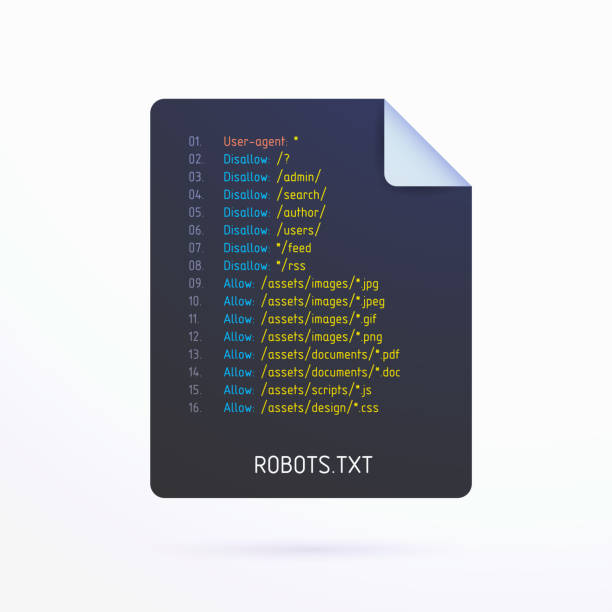

11.Robots.txtファイルとは?

robots.txt は、サイト運営者がクローラーに対して、どの領域をクロール対象にするかを伝えるためのテキストファイルです。これは Robots Exclusion Protocol に基づく運用上の指示であり、アクセス認可そのものではありません。通常はWebサイトのルートディレクトリに配置され、主に次のような内容を記載します。

- クロール対象の指定:どのクローラーに対して、どのページやディレクトリを対象とするかを指定します。

- クロール対象外の指定:特定のページやディレクトリをクロール対象から外すよう示します。

- その他の補足情報:

sitemapなど、クローラーが解釈できる追加情報が記載されることがあります。なお、crawl-delayのような記述は公式標準には含まれておらず、対応状況はクローラーによって異なります。

robots.txt はスクレイピングやクローリングを検討する際の重要な確認事項のひとつですが、それだけで可否を判断するのではなく、利用規約や対象データの性質もあわせて確認することが重要です。

12.CAPTCHAを解消できる?

CAPTCHAは、Webスクレイピングを防止するために設計された仕組みですが、これを解決する方法も存在します。次のような手法が一般的です。

- OCR(光学文字認識):CAPTCHA画像を解析し、文字を認識する技術。簡単なCAPTCHAには有効ですが、高度なものには限界があります。

- 第三者サービスの利用:CAPTCHA解決を専門とするサービスを利用し、APIを介してCAPTCHAを解決します。これには追加のコストが発生しますが、効果的です。

- ユーザーインタラクションの模倣:ユーザーの操作をシミュレーションするツールを使用して、CAPTCHAを手動で解決するように見せかける方法。

これらの手法を用いることで、CAPTCHAを回避してデータをスクレイピングすることが可能ですが、法的リスクや道徳的問題を考慮する必要があります。

関連記事:Webスクレイピングで知るべき5つのCAPTCHA知識

13.定期的にWebサイトから継続的にデータを収集する方法は?

定期収集は、OSのcron、CI/CDのスケジュール実行、Octoparseのクラウドのスケジューラ機能などを使って自動化できます。実務では、単に一定間隔で取りに行くだけでなく、更新差分のみを取得する、失敗時の再試行を設ける、取得結果を監視する、といった運用設計も重要です。必要以上に高頻度で巡回するのではなく、業務上必要な更新頻度に合わせて設計するのが基本です。

定期的にWebサイトからデータを収集するためには、以下の方法が一般的です。

- スケジューリング:スクレイピングツールやスクリプトにスケジューリング機能を追加して、特定の時間や間隔で自動的にデータを収集するように設定します。例えば、Pythonではcronジョブやscheduleライブラリなどを使用できます。

- クラウドサービスの利用: 部のクラウドスクレイピングサービスは、定期的なデータ収集をサポートしており、設定したスケジュールに従って自動的にスクレイピングを実行できます。

- 通知機能:データ収集が完了した後に通知を受け取る機能を追加することで、データの更新状況や異常をタイムリーに確認できます。

これにより、必要なタイミングで継続的にデータを取得しやすくなります。

関連記事:タスクのスケジュール実行、通知機能

14.ブロックされないようにするためにはどうすればよい?

Webスクレイピング中にブロックされないようにするためには、以下の対策を講じることが重要です。

- アクセス頻度を調整:サイトに過度な負荷をかけないように、リクエスト間の時間を適切に設定します。

- ユーザーエージェントの変更:リクエストに異なるユーザーエージェントを設定し、人間のブラウザからのアクセスのように見せかけます。

- プロキシの使用:複数のIPアドレスを使用するプロキシを利用して、単一のIPアドレスからの大量アクセスを避けます。

- アクセスパターンのランダム化:アクセスする時間や順序をランダムに変更することで、ボットの挙動を検出しにくくなります。

- robots.txtの遵守:サイトのrobots.txtファイルを確認し、指定されたルールに従ってスクレイピングを行います。

これらの対策を適切に実施することで、Webサイトからのブロックを回避し、効率的にデータを収集することができます。

関連記事:スクレイピングテクニック – バレないようにする方法を解説

15.画像を直接ダウンロードできる?

はい、Webスクレイピングを利用して画像を直接取得することは技術的には可能です。以下の手順が一般的です。

- 画像URLの取得:まず、WebページのHTMLや表示内容を解析し、画像のURLを抽出します。通常、

<img>タグのsrc属性やsrcset属性などに画像のURLが含まれています。 - 画像のダウンロード:抽出したURLを使ってHTTPリクエストを送信し、画像データを取得します。取得した画像データはローカルストレージなどに保存できます。

- 自動化ツールの使用:OctoparseなどのWebスクレイピングツールを使用すると、画像URLの抽出や画像ファイルの取得を自動化できる場合があります。

これらの方法を使用することで、画像を効率的に収集できる場合があります。ただし、取得後の利用については、著作権、利用規約、プライバシーなども含めて確認が必要です。

16.オススメのWebスクレイピングツールとは

おすすめは、目的と技術レベルで変わります。ノーコードで始めたい場合はOctoparseやParseHubのようなツール、Pythonで柔軟に構築したい場合はScrapyやBeautiful Soup、ブラウザ自動化が必要な場合はSeleniumやPuppeteerが代表例です。大切なのは「どれが最強か」ではなく、対象サイトの複雑さ、必要な保守性、チームのスキルに合うものを選ぶことです。

Webスクレイピングツールは多数存在し、それぞれ異なる特徴と機能が備わっています。以下にいくつかのおすすめツールを紹介します。

- Octoparse:ノーコードのスクレイピングツールで、ドラッグ&ドロップのインターフェースを提供します。初心者でも比較的使いやすいのが特徴です。

- Scrapy:Pythonで構築されたオープンソースのスクレイピングフレームワークです。柔軟性が高く、大規模なスクレイピングプロジェクトに適しています。

- Beautiful Soup:HTMLやXMLの解析に強いPythonライブラリです。比較的シンプルなスクレイピングタスクに適しています。

- Selenium:Webブラウザを自動化するツールです。JavaScriptで生成される動的コンテンツの取得に便利です。

- ParseHub:ビジュアルプログラミングインターフェースを提供するノーコードツールです。使いやすさと柔軟性を兼ね備えています。

それぞれのツールには向き・不向きがあるため、特定の用途やスキルレベルに応じて選択することが重要です。

関連記事: Webスクレイピングツール30選

17.TikTokやX(Twitter)のスクレイピングはできる?

TikTokやX (旧Twitter)のスクレイピングは技術的には可能ですが、いくつかの課題と法的な考慮点があります。

- 技術的な課題:これらのプラットフォームは、スクレイピングを防ぐための高度な技術を採用しています。たとえば、頻繁なレートリミットやCAPTCHAによる対策がされています。

- APIの利用:公式APIを利用することで、プラットフォームのデータにアクセスできますが、使用制限や費用が発生する場合があります。

- 法的制約:利用規約でスクレイピングを禁止していることが多く、無断でスクレイピングを行うとアカウントの凍結や法的措置の対象となる可能性があります。

これらのプラットフォームからデータを取得する場合は、公式APIの利用を検討し、利用規約に従うことが重要です。

関連記事:無料でX(Twitter)からデータをスクレイピング・取得する方法を解説!

18.Webスクレイピングの活用事例は?

活用例としては、価格モニタリング、公開情報の一覧化、メディアモニタリング、研究用データの収集、更新監視などが挙げられます。記事では、派手に「何でも取れる」と書くより、目的を絞って継続的に情報を整備するための手段として紹介するほうが現実的です。

Webスクレイピングは、多岐にわたる業界や用途で活用されています。主な活用例は次のとおりです。

- 市場調査:競合他社の価格情報や製品データを収集し、マーケット分析や価格戦略の検討に役立てます。

- 不動産業界: 物件情報や価格動向を定期的に収集し、相場分析やマーケティング活動に利用します。

- ニュース収集:複数のニュースサイトから記事を収集し、トレンド分析やメディアモニタリングを行います。

- ソーシャルメディア分析:ソーシャルメディアプラットフォームからデータを抽出し、ブランド評価や消費者の声を分析します。

- 学術研究:大規模な公開データを収集し、データサイエンスや機械学習の研究に利用します。

これらの活用事例は、Webスクレイピングが公開情報を整理・分析し、意思決定に役立てるための手段として幅広く利用されていることを示しています。

19.Webスクレイピングは違法?

Webスクレイピングという技術そのものが直ちに違法というわけではありません。ただし、適法性は、対象データ、アクセス方法、認証の有無、利用規約、取得後の利用方法によって変わります。したがって、「違法か合法か」を一律に断定するのではなく、案件ごとに対象・方法・用途を確認する必要があります。

Webスクレイピング自体は技術的な手法ですが、対象や方法によっては法的な問題が発生する可能性があります。

- 利用規約との関係:対象サイトの利用規約で自動取得が制限されている場合があります。規約違反が直ちに同じ法的結論を意味するわけではありませんが、重要な確認事項です。

- 著作権との関係:取得した情報の内容や利用方法によっては、著作権の問題が生じることがあります。特に再配布、転載、商用利用などは慎重な判断が必要です。

- 個人情報・プライバシーとの関係:個人に関する情報を扱う場合は、個人情報保護やプライバシーの観点から追加の注意が必要です。

- アクセス方法の適法性:認証のない公開情報の取得と、認証を伴う領域や制限された領域へのアクセスとでは、法的な論点が異なります。過度な負荷や不適切なアクセス方法は、別の法的問題につながる可能性もあります。

法的問題を避けるためには、対象サイトの利用規約、対象データの性質、アクセス方法、取得後の利用目的を個別に確認しながら進めることが重要です。

関連記事:スクレイピングは違法?Webスクレイピングに関する10のよくある誤解

20.Webサイトの利用規約に違反した場合はどうなる?

まず起こりやすいのは、技術的な制限です。たとえば、レート制限、ボット判定、Challenge、アクセス遮断、アカウント側の制限などです。加えて、状況によっては、収集データの削除要請、契約・利用規約違反に基づく対応、さらに認証の不正利用や業務妨害に当たるような態様であれば、別の法的問題に発展する可能性もあります。記事としては、「規約違反=直ちに同じ結果になる」とは書かず、運営者側の技術的・契約的・法的対応があり得る、という整理にとどめるのが安全です。

Webサイトの利用規約に違反してスクレイピングを行った場合、以下のような結果が考えられます。

- アクセスのブロック:Webサイトの管理者が、IPアドレスやアクセス経路に対して制限をかけることがあります。

- アカウントの凍結:ログインが必要なサイトでは、アカウントの停止や制限が行われる可能性があります。

- 契約上・法的な対応:違反の内容や影響の程度によっては、警告、利用停止、損害賠償請求、訴訟などの対応が取られる可能性があります。

- データ削除の要求:収集したデータについて、削除や利用停止を求められることがあります。

そのため、スクレイピングを行う際は、利用規約を確認したうえで、対象サイトに配慮した適切な方法で進めることが重要です。

まとめ

本記事では、Webスクレイピングに関する20のよくある質問に対して簡単に解説しました。Webスクレイピングは、インターネット上のデータを収集し、ビジネスや研究に活用するための強力なツールです。

しかし、技術的な課題や法的な考慮点も多く存在します。スクレイピングを行う際は、利用規約を遵守し、倫理的かつ合法的な方法を選択することが重要です。