スクレイピングツールとは?仕組みをやさしく解説

スクレイピングツールとは、Webサイト上の情報を自動的に抽出(スクレイピング)するためのソフトウェアです。

たとえば、ECサイト上の商品名・価格・レビュー数を一覧にまとめたい場合、手作業なら1件ずつコピー&ペーストするしかありません。しかし、スクレイピングツールを使えば、数百〜数千件のデータを数分で自動取得し、ExcelやCSVファイルとして出力できます。

スクレイピングの基本的な仕組みは、次のような流れです。

まず、ツールが指定されたURLにアクセスしてWebページのHTMLソースコードを取得します。次に、あらかじめ設定したルール(CSSセレクタやXPathなど)に従って、ページ内の特定の要素——たとえば商品名が記載されたタグや、価格が表示されている箇所——を識別します。最後に、抽出されたデータをCSV、Excel、JSON、データベースといった利用しやすい形式に変換して出力します。

ツールの種類によって、この「ルール設定」の部分が大きく異なります。コードを書く必要があるもの、マウス操作だけで設定できるもの、AIが自動で設定してくれるもの——自分のスキルや目的に合ったタイプを選ぶことが、スクレイピングツール導入成功の鍵になります。

スクレイピングツール導入で得られる3つのメリット

メリット1:データ収集にかかる時間を大幅に短縮

手作業で1時間かかっていた情報収集が、スクレイピングツールを使えばわずか数分で完了します。日常的にWebサイトの価格調査や競合チェック、営業リスト作成をしている方にとって、この時間短縮のインパクトは大きいでしょう。浮いた時間を分析や企画といった本来注力すべき業務に回すことができます。

メリット2:人的ミスを防ぎ、データの正確性を確保

手作業でのコピー&ペーストでは、見落としや転記ミスが避けられません。スクレイピングツールなら、設定どおりのルールで一貫してデータを取得するため、ヒューマンエラーが発生しません。特に大量のデータを扱う場面では、正確性の違いが業務品質に直結します。

メリット3:定期実行で情報を常に最新に保てる

多くのスクレイピングツールには、データ取得の定期実行(スケジュール機能)が備わっています。たとえば「毎朝9時に競合10社の価格を自動チェックして、スプレッドシートに反映する」といった運用が可能です。常に最新の情報に基づいた意思決定ができるようになります。

導入前に知っておくべき注意点

スクレイピングツールは強力な業務効率化手段ですが、使い方を誤るとトラブルにつながる可能性もあります。以下の3点は、導入前に必ず確認しておきましょう。

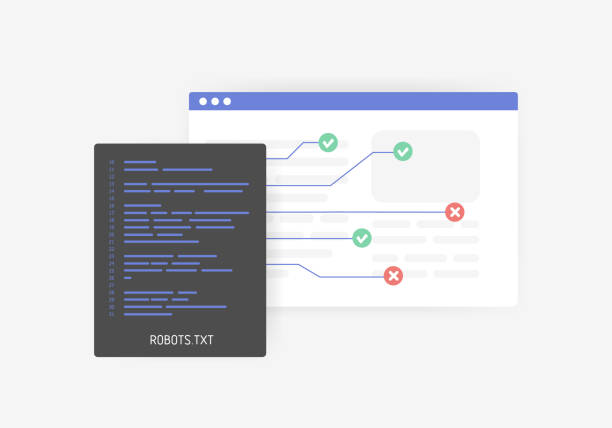

利用規約とrobots.txtの確認は必須

Webサイトによっては、自動的なアクセスやデータ取得を利用規約で禁止している場合があります。また、robots.txtというファイルでクローラーのアクセスを制限しているサイトもあります。スクレイピングを実行する前に、対象サイトのルールを必ず確認してください。

サーバーへの負荷に配慮する

短時間に大量のリクエストを送ると、対象サイトのサーバーに過度な負荷をかけてしまいます。リクエスト間隔は最低でも1秒以上空けることが推奨されており、大規模な取得を行う場合はさらに余裕を持った設定が必要です。

取得データの利用範囲を意識する

スクレイピングで取得したデータの利用にも注意が必要です。個人的な調査や社内分析であれば問題になるケースは少ないですが、取得データを商用目的で再配布する場合は著作権法や個人情報保護法に抵触する可能性があります。

スクレイピングツール5つのタイプと選び方

2026年現在、スクレイピングツールは主に5つのタイプに分類できます。それぞれの特徴を理解したうえで、自分の業務に合ったものを選びましょう。

| タイプ | 概要 | メリット | デメリット | 向いている人 |

| クラウド型ノーコード | ブラウザ上で設定、クラウドで実行 | インストール不要、PCオフでも取得可、大規模対応 | 月額コストが発生する場合あり | プログラミングなしで本格運用したい人 |

| Chrome拡張機能型 | ブラウザに追加して使用 | 導入が簡単、閲覧中のページをそのまま取得 | 大量取得・定期実行は不得意 | 少量のデータをすぐ取りたい人 |

| インストール型 | PCにソフトをインストール | 処理速度が速い、大量データに強い | PC依存、常時起動が必要 | 大規模データを高速処理したい人 |

| RPA型 | 業務プロセス全体を自動化 | データ取得後の加工・通知まで自動化可 | スクレイピング単体で使うにはオーバースペック | データ収集だけでなく後工程も自動化したい人 |

| AI搭載型(2026年注目) | AIがページ構造を自動解析 | 設定不要でレイアウト変更にも追従 | AI処理分の遅延、まれに誤抽出 | 技術知識ゼロで始めたい人 |

選び方の基本指針: まず「どの程度のデータ量を、どのくらいの頻度で取得したいか」を明確にしてください。少量&単発ならChrome拡張機能で十分。定期的に数百〜数千件を取得するならクラウド型。データ取得後の加工やシステム連携まで自動化したいならRPA型が適しています。

【タイプ別】おすすめスクレイピングツール12選

■ クラウド型ノーコードツール

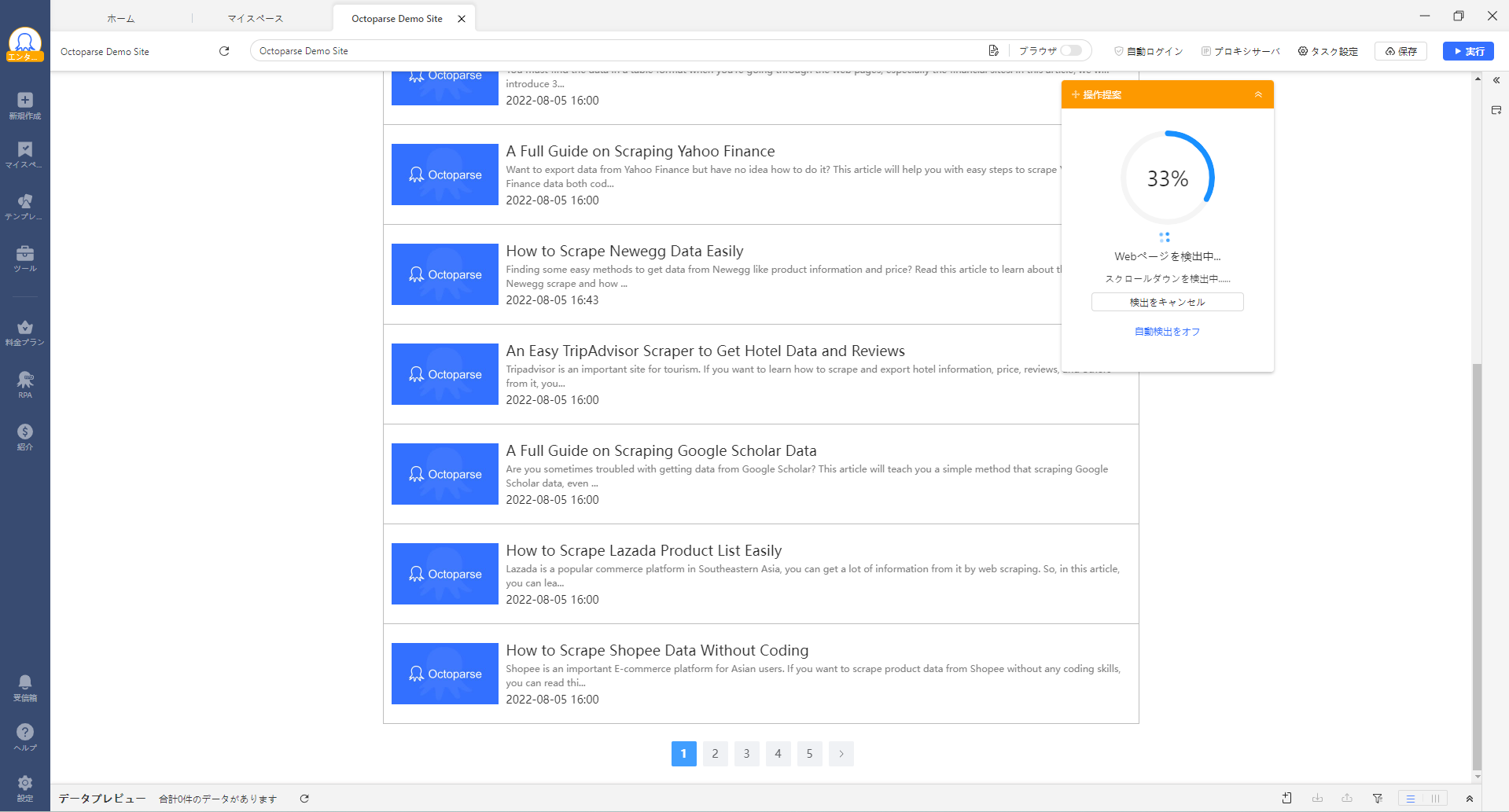

1. Octoparse

【概要・特徴】

Octoparseは、全世界で600万人以上が利用するクラウド型のスクレイピングツールです。最大の特徴は、Webページの自動識別機能。URLを入力するだけでページ構造を解析し、取得すべきデータを自動で検出します。XPathやCSSセレクタの知識がなくても、マウス操作だけでスクレイピングの設定が完了します。

さらに、Amazon、楽天、Googleマップ、X(旧Twitter)など主要サイト向けのスクレイピングテンプレートが豊富に用意されており、パラメータを入力するだけで即座にデータ収集を開始できます。2026年に追加されたMCP AI機能では、AIエージェントとの連携によるインテリジェントなデータ取得も実現しています。

クラウド上で24時間スケジュール実行でき、IPローテーション対応でアクセスブロックも回避。取得データはCSV、Excel、JSON、APIでの出力に対応しています。日本語サポートが提供されている点も、国内ユーザーにとっての大きな安心材料です。

【料金】

Free(無料)/ Standard $119/月 / Professional $299/月 / Enterprise(問い合わせ)

*14日間の無料トライアルあり

【公式サイト】https://www.octoparse.jp/

2. 80legs

【概要・特徴】

80legsはカスタムWebクロールに対応したクラウド型スクレイピングツールです。無料プランでもクロール回数に制限がなく、1回のクロールで最大10,000URLを処理できるため、試験的なデータ収集から始めたい場合に便利です。

大規模なデータ取得に強みを持つ一方、UIは英語のみで操作画面もシンプルなため、ある程度のWeb知識がある方に向いています。

【料金】

Free(無料)/ Intro $29/月 / Plus $99/月 / Premium $299/月

【公式サイト】https://80legs.com/

3. Crawly

【概要・特徴】

CrawlyはWebサイトのURLを入力するだけでデータを自動抽出してくれる、シンプルなクラウドツールです。必要なのはURLとメールアドレスのみ。取得データはCSV・JSON形式で出力でき、面倒な設定は一切不要です。

「スクレイピングがどういうものか、まず体験してみたい」という方には最適な入口になるツールです。ただし、細かいカスタマイズや大規模な運用には向いていません。

【料金】無料

【公式サイト】https://crawly.diffbot.com/

■ Chrome拡張機能型ツール

4. Web Scraper

Web Scraperは、Google ChromeとFirefoxの拡張機能として利用できるスクレイピングツールです。ブラウザのデベロッパーツール内で「サイトマップ」を作成し、ページ構造に合わせてデータ抽出のルールを設定します。

無料のプラグイン版でもローカルでのデータ取得は十分に機能します。JavaScriptで動的に生成されるサイトにも対応しているため、拡張機能型としては高い柔軟性を備えています。より高度な機能が必要な場合は、クラウド版の有料プランも用意されています。

【料金】拡張機能は無料

【公式サイト】https://webscraper.io/

5. Listly

Listlyは、ワンクリックでWebページ上のデータをリスト化できるChrome拡張機能です。取得したデータはそのままExcelやGoogleスプレッドシートにエクスポートできるため、操作が非常にシンプルです。画像のダウンロードにも対応しており、無料プランでも1回あたり50枚まで取得可能です。

「難しい設定は抜きにして、今見ているページのデータをサクッと取りたい」というニーズに応えてくれるスクレイピングツールです。

【料金】無料

【公式サイト】https://www.listly.io/ja/

■ インストール型ツール

6. ParseHub

ParseHubは、Mac・Windows・Linuxに対応したデスクトップ型のスクレイピングツールです。ビジュアルなインターフェースで、Webサイト上の要素をクリックするだけでデータ抽出のルールを設定できます。IPローテーション機能も備えており、アクセス制限のあるサイトにも対応します。

無料プランでは、40分で200ページのデータを取得可能です。チュートリアルが充実しているため、初めてインストール型ツールを使う方でも学びやすい環境が整っています。ただし、ドキュメントは英語表記です。

【料金】Free(無料)/ Standard $189/月 / Professional $599/月

【公式サイト】https://www.parsehub.com/

7. WebHarvy

WebHarvyはWindows向けのスクレイピングツールで、ポイント&クリック方式でデータ抽出ルールを設定できます。Excel、XML、CSV、JSON、TSVなど多様な出力形式に対応しているほか、SQLデータベースへの直接書き込みも可能です。

買い切り型のライセンスモデルを採用しており、継続的な月額コストが発生しない点が特徴です。15日間の無料トライアル(最大2ページ分のデータ取得可能)が提供されています。

【料金】シングルユーザー $99(買い切り)/ 15日間無料トライアルあり

【公式サイト】https://www.webharvy.com/

■ RPA型ツール

8. Coopel

Coopelは、プログラミング知識が一切不要なクラウド型RPAツールです。ドラッグ&ドロップでワークフローを組み立てるため、非エンジニアでもWebスクレイピングと後工程(データ加工、通知、ファイル保存)を一気通貫で自動化できます。

月額12,800円からという手頃な価格設定と、30日間の無料トライアル、日本語サポートが魅力です。ただし、スクレイピング単体の用途だけで見ると、専用ツールに比べてオーバースペックになる可能性があります。

【料金】エントリー ¥12,800/月 / スタンダード ¥50,000/月 無料トライアル: 30日間

【公式サイト】https://coopel.ai/

9. Power Automate

Power Automateはマイクロソフトが提供するRPAツールで、Microsoft 365のExcel、OneDrive、Teamsなどとシームレスに連携できるのが最大の強みです。AI機能「Copilot」が自動化フローの作成を支援してくれるため、初心者でもワークフローの構築がしやすくなっています。

既にMicrosoft 365を導入している企業であれば、追加投資を最小限に抑えながらスクレイピングの自動化を実現できます。

【料金】無料試用版あり / Premium ¥2,248/ユーザー/月

【公式サイト】https://www.microsoft.com/ja-jp/power-platform/products/power-automate

10. UiPath

UiPathは世界的に高い評価を受けるRPAツールです。小規模な自動化から全社規模の展開まで対応でき、60日間という長めの無料トライアル期間が設けられています。

非常に多機能なため、スクレイピングだけでなく業務プロセス全体の自動化を見据えている企業に適しています。一方で、簡単なデータ収集だけが目的の場合はオーバースペックと感じるかもしれません。

【料金】ベーシック $25〜/月 60日間無料トライアルあり

【公式サイト】https://www.uipath.com/ja

■ AI搭載型ツール(2026年注目)

11. Thunderbit

Thunderbitは、AI搭載のChrome拡張機能型スクレイピングツールです。ページを開いて「AIサジェストフィールド」をクリックするだけで、AIがページ構造を解析し、最適な抽出カラム(商品名、価格、説明文など)を自動提案してくれます。

ユーザーはわずか2クリックでデータ取得が完了するため、技術知識が一切ない方でも直感的に使い始められます。サブページやページネーションの自動巡回にも対応しており、複数ページにまたがるデータの一括取得も可能です。取得データはExcel、Google Sheets、Airtable、Notionなどに直接エクスポートできます。

【料金】無料クレジットあり / 有料プランあり

【公式サイト】https://thunderbit.com/

12. ShtockData

ShtockDataは日本発のAI搭載スクレイピングツールです。独自のAIデータ整形機能により、通常は手作業での調整が必要なデータも自動でクレンジング・構造化してくれます。初期費用0円で導入でき、日本人スタッフによるサポート体制が整っている点が安心材料です。

海外サイトのスクレイピングにも対応しており、各企業の要件に合わせたカスタム料金プランを提案しています。

【料金】初期費用0円 / カスタムプラン(要問い合わせ)/ 無料トライアルあり

【公式サイト】要問い合わせ

12ツール一覧比較表

| ツール名 | タイプ | 無料プラン | 日本語対応 | 動的サイト | 定期実行 | AI機能 |

|---|---|---|---|---|---|---|

| Octoparse | クラウド型 | ○ | ○ | ○ | ○ | ○ |

| 80legs | クラウド型 | ○ | ✕ | △ | ○ | ✕ |

| Crawly | クラウド型 | ○ | ✕ | ✕ | ✕ | ✕ |

| Web Scraper | 拡張機能 | ○ | ✕ | ○ | △ | ✕ |

| Listly | 拡張機能 | ○ | ○ | △ | ✕ | ✕ |

| ParseHub | インストール | ○ | ✕ | ○ | ○ | ✕ |

| WebHarvy | インストール | 体験版 | ✕ | ○ | ○ | ✕ |

| Coopel | RPA | 30日間 | ○ | ○ | ○ | ✕ |

| Power Automate | RPA | 30日間 | ○ | ○ | ○ | ○ |

| UiPath | RPA | 60日間 | ○ | ○ | ○ | △ |

| Thunderbit | AI搭載 | クレジット | △ | ○ | ○ | ○ |

| ShtockData | AI搭載 | 体験版 | ○ | ○ | ○ | ○ |

2026年注目:AIスクレイピングという新潮流

2026年、スクレイピングツールの世界で最も大きな変化はAIの本格的な統合です。

従来のスクレイピングでは、Webサイトの構造に合わせてCSSセレクタやXPathを手動で設定する必要がありました。サイトのデザインが少し変わるだけでルールが機能しなくなり、その都度メンテナンスが必要になるのが大きな課題でした。

AIを搭載したスクレイピングツールは、大規模言語モデル(LLM)や機械学習を活用して、ページの内容を「意味」で理解します。つまり、HTMLの構造が変わっても、「これは商品名」「これは価格」「これはレビュー」といった文脈を読み取って自動でデータを抽出できるのです。

Octoparseも2026年にMCP AI機能を追加し、AIエージェントとの連携によるインテリジェントなデータ取得を実現しています。これにより、従来はエンジニアが設定していたような複雑なスクレイピングも、ビジネスユーザーが自然言語で指示を出すだけで実行できるようになりつつあります。

よくある質問(FAQ)

Q1. スクレイピングツールは無料で使えますか?

はい、多くのスクレイピングツールには無料プランや無料トライアルが用意されています。たとえばOctoparseのFreeプランでは、10タスクまで無料でスクレイピングを実行できます。まずは無料プランで試してみて、業務に合うかどうかを確認するのがおすすめです。

Q2. プログラミングの知識がなくてもスクレイピングツールは使えますか?

はい、ノーコード型やAI搭載型のスクレイピングツールなら、プログラミング知識は一切不要です。マウス操作やURLの入力だけでデータ取得が可能なツールが増えています。本記事で紹介した12ツールのうち大半は、非エンジニアでも利用可能です。

Q3. スクレイピングは違法ですか?

スクレイピング技術自体は違法ではありません。ただし、対象サイトの利用規約やrobots.txtの指示を遵守する必要があります。また、取得データの利用目的によっては著作権法や個人情報保護法に抵触する可能性があるため、商用利用する場合は事前確認が重要です。

Q4. クラウド型とインストール型、どちらがいいですか?

用途によって異なります。インストール型は処理速度に優れ、大量データの高速取得に向いています。一方、クラウド型はPCの電源が切れていてもスケジュール実行でき、複数デバイスからアクセスできる利便性があります。チームでの共同利用や定期実行が必要なら、クラウド型が便利です。

Q5. 2026年にスクレイピングツールを選ぶなら何を重視すべきですか?

2026年の選定で特に重視すべきは、AI対応とメンテナンス性です。Webサイトは頻繁にデザインやHTML構造を変更するため、従来型の固定ルールによるスクレイピングは保守コストが高くなりがちです。AIがページ構造を自動認識してくれるツールを選べば、メンテナンスの手間を大幅に削減できます。

まとめ:現場で本当に使えるツールの見極め方

正直に言うと、スクレイピングツールの比較記事を読んでも「結局どれがいいのか分からなかった」という経験は誰にでもあると思います。筆者自身も、いくつものツールを試しては乗り換えてきました。

その経験から言えることは、最初から「最高のツール」を探す必要はないということです。

もしあなたが初めてスクレイピングに触れるなら、まずはCrawlyでスクレイピングの体験そのものをしてみてください。URLを入力するだけで動く手軽さが、スクレイピングへの心理的ハードルを下げてくれます。

次に「もう少し本格的にやりたい」と思ったら、Web ScraperやListlyのようなChrome拡張機能を試すのが自然なステップです。

そして「定期的にデータを自動収集したい」「コードは書きたくないけど大量のデータが必要」という段階に来たら、Octoparseのようなクラウド型ツールが本領を発揮します。テンプレートで即座に始められるうえ、スケジュール実行やIPローテーションなど、運用に必要な機能が一通り揃っています。

大事なのは、自分の「今の課題」に合ったツールを選ぶこと。そしてその課題が変わったら、そのときにまた次のツールを検討すればいい。

この記事が、あなたにとって最初の一歩を踏み出すきっかけになれば幸いです。

まずは無料で試してみる → Octoparse 無料ダウンロード

関連記事:

- スクレイピングは違法?Webスクレイピングに関するよくある誤解

- 【2026年最新】Chrome拡張機能おすすめスクレイピングツール5選

- スクレイピングにおける10の課題と対策

- Webスクレイピング入門ガイド

- IP禁止回避ガイド

- Octoparse MCP AI