「データ準備=社内データを整備すること」と思っていませんか?

売上データや顧客データをきれいに揃えても、「なぜ競合に負けているのか」「市場全体でどう見られているのか」が見えてこない——そういった壁にぶつかる担当者は少なくありません。原因のひとつは、分析に使うデータがすべて社内から来ていることにあります。

| 著者の実体験 以前、食品メーカーのクライアントで売上・顧客データの整備を4週間かけて完成させたにもかかわらず、「なぜ競合ブランドに価格で負けているのか」という問いに答えが出ませんでした。 上司から「社外のデータも見てみたら?」と言われ、競合ECの価格データを収集して重ね合わせた瞬間、分析の解像度が一段と上がった——データ準備の対象を社外まで広げるだけで、見えるものがこれほど変わるとは思っていませんでした。 |

本記事では、データ準備(データプレパレーション)の基本から社内データ整備の5ステップ、そして見落とされがちな社外Webデータをデータ準備の対象として加える考え方まで、一気通貫で解説します。

データ準備(データプレパレーション)とは?ETLとの違いも表で整理

データ準備(データプレパレーション)とは、収集したデータを分析・可視化できる状態に整える前処理の工程全般を指します。

データ分析の現場では、実作業の大半がこの「準備」に費やされています。CrowdFlowerの調査をもとにForbesが報告したデータによると、データサイエンティストの業務の約80%がデータ収集・準備に費やされているとされています。どれほど優れたBIツールや分析モデルを導入しても、データ自体が分析できる状態でなければ意味をなしません。

参考:Forbes|Cleaning Big Data: Most Time-Consuming, Least Enjoyable Data Science Task

データ準備とETLの違い

データ準備とよく混同されるのが「ETL」です。ETL(Extract・Transform・Load)とは、システム間のデータ連携を目的とした技術的な処理を指します。一方、データ準備はビジネス担当者が分析のために行う「前処理」です。「ETLはエンジニアの仕事、データ準備はビジネス担当者の仕事」と覚えておくと整理しやすくなります。

| 比較軸 | データ準備 | ETL |

| 対象ユーザー | ビジネス担当者・マーケター | エンジニア・IT部門 |

| 操作難易度 | GUIツールで対応可(コーディング不要) | コーディングが必要なケース多い |

| 目的 | 分析・可視化のための前処理 | システム間のデータ連携・移送 |

| 適した場面 | 単発・反復的な分析準備 | 定期・大規模なデータパイプライン |

「どちらが優れているか」ではなく、「誰が何のために使うか」で使い分けるものです。

社内データの準備:クレンジングから分析投入までの5ステップ

ここからは社内データを分析できる状態にするまでの流れを5つのステップで解説します。

ステップ1. 収集・集約

CRM・POSシステム・Excelファイル・メールなど、社内の複数箇所に分散したデータをひとつに集めます。「どこに何があるか」を棚卸しするところから始めるのが実態です。この一歩を省略すると、後で重複データや抜け漏れが発生し、分析結果の信頼性が崩れます。

ステップ2. クレンジング

欠損値(空白セル)の補完・削除、「株式会社」と「(株)」のような表記ゆれの統一、明らかに異常な外れ値の除外などを行います。ここを怠ると後の分析結果が歪む原因になります。

Webから自動収集した社外データのクレンジング方法については、データ収集を自動化するスクレイピングツールの解説記事もあわせてご参照ください。

ステップ3. 変換・統合

単位や日付形式を統一し、複数ソースのデータを結合できる状態にします。売上データとCRMの顧客データをID列で突き合わせる作業がこれにあたります。この工程で初めて「横断分析」が可能になります。

ステップ4. 検証

BIへ投入する前の最終確認です。件数が想定と合っているか、数値の値域が正常範囲内か、サンプルを目視して異常がないかをチェックします。この一手間が誤った分析結果を防ぐ関門になります。

ステップ5. BI/AIへ投入

検証が完了したデータをBIツールや分析基盤に渡し、可視化・モデリングへと進みます。ここまで来て初めて「データを活用した意思決定」のスタートラインに立てます。

どのBIツールを選ぶか迷っている方は、おすすめBIツール25選の比較記事も参考になります。

データ準備の対象を社外Webデータにまで広げる

ここまでは社内データのデータ準備を解説しました。ただ、5つのステップを丁寧に踏んでも「なぜ競合が伸びているのか」「市場からどう見られているか」という問いには答えが出ません。

理由はシンプルで、競合の価格・求人市場の動向・SNSの口コミはすべて社外にあるからです。これらも「分析できる状態に整える必要があるデータ」——つまりデータ準備の対象です。社内データと社外データの両方を整備して初めて、精度の高い分析が可能になります。

社外Webデータ:データ準備が必要な主な種類

社外Webデータにはさまざまな種類がありますが、ビジネス担当者・マーケターが特に活用しやすいのは以下の3つです。

- 競合の価格・商品データ(EC) ——自社の売上データと組み合わせることで、競合値下げのタイミングと自社売上の変化を紐づけた価格戦略の根拠づけが可能になります。

- https://www.octoparse.jp/template/amazon-japan-product-details-scraper

- 求人サイトの給与・条件データ ——業界・職種別の給与水準と自社の条件を比較し、採用要件の見直しに活用できます。

- https://www.octoparse.jp/template/doda-job-detail-scraper

- SNS・レビューの口コミデータ ——ネガポジ分類で顧客不満のパターンを数値化し、社内の問い合わせデータと照合することで見えていなかった課題が浮かび上がります。

- https://www.octoparse.jp/template/twitter-scraper-by-keywords

各ユースケースの具体的な収集・活用方法は、Webスクレイピングでビジネスを成長させる方法30選で詳しく解説しています。

社外データのデータ準備フロー

収集した社外WebデータはそのままではBIに投入できません。社内データと同じく「準備」が必要です。

- データ収集(スクレイピングツールでキーワード・URLを入力して自動取得)

- フォーマット統一(通貨記号の除去・文字列→数値変換・日付形式の統一)

- 社内データと結合(商品IDや企業名をキーに突き合わせ)

- 検証(件数・値域チェック)

- BI投入

このフローのうち「ステップ1〜2(収集+フォーマット統一)」を担うツールとして、ビジネス担当者に多く使われているのがOctoparseのようなノーコード型のWebデータ収集ツールです。コーディング不要で、ExcelやCSV形式でデータを出力できるため、社内データ整備と同じ感覚でデータ準備のフローに組み込めます。スケジューラーによる定期自動収集にも対応しており、一度設定すれば競合の価格変動や求人動向を継続してモニタリングできます。

実際の収集方法や活用事例については、データスクレイピングとは?仕組みと活用シーンもあわせてご覧ください。

| 【ご注意】 Webスクレイピングを行う際は、対象サイトの利用規約を事前に確認し、サーバーへの過度な負荷をかけない方法で実施してください。収集したデータの用途が個人・社内利用の範囲に留まっているかについても必ず確認してください。 |

Octoparseの役割(データ準備を拡張するツールとして)

なぜOctoparseがデータ準備プロセスで使われるのか

社内データの整備と同様に、社外Webデータも「収集→整形→分析可能化」というデータ準備のプロセスを経る必要があります。しかし、競合価格・求人情報・口コミなどのWebデータは手作業で集めるには限界があります。

そこでOctoparse(オクトパス・オクトパース)のようなノーコードWebスクレイピングツールが使われます。これは単なるデータ収集ツールではなく、データ準備の初期工程を効率化する役割を持っています。

具体的には以下のような特徴があります:

- プログラミング不要でWebページから構造化データを抽出できる

- 定期実行(スケジューリング)により市場変化を継続的に取得できる

- CSV・Excel形式で出力でき、そのままBIツールや社内データと統合できる

つまりOctoparseは「社外データを分析可能な形に変換する入口」として機能します。

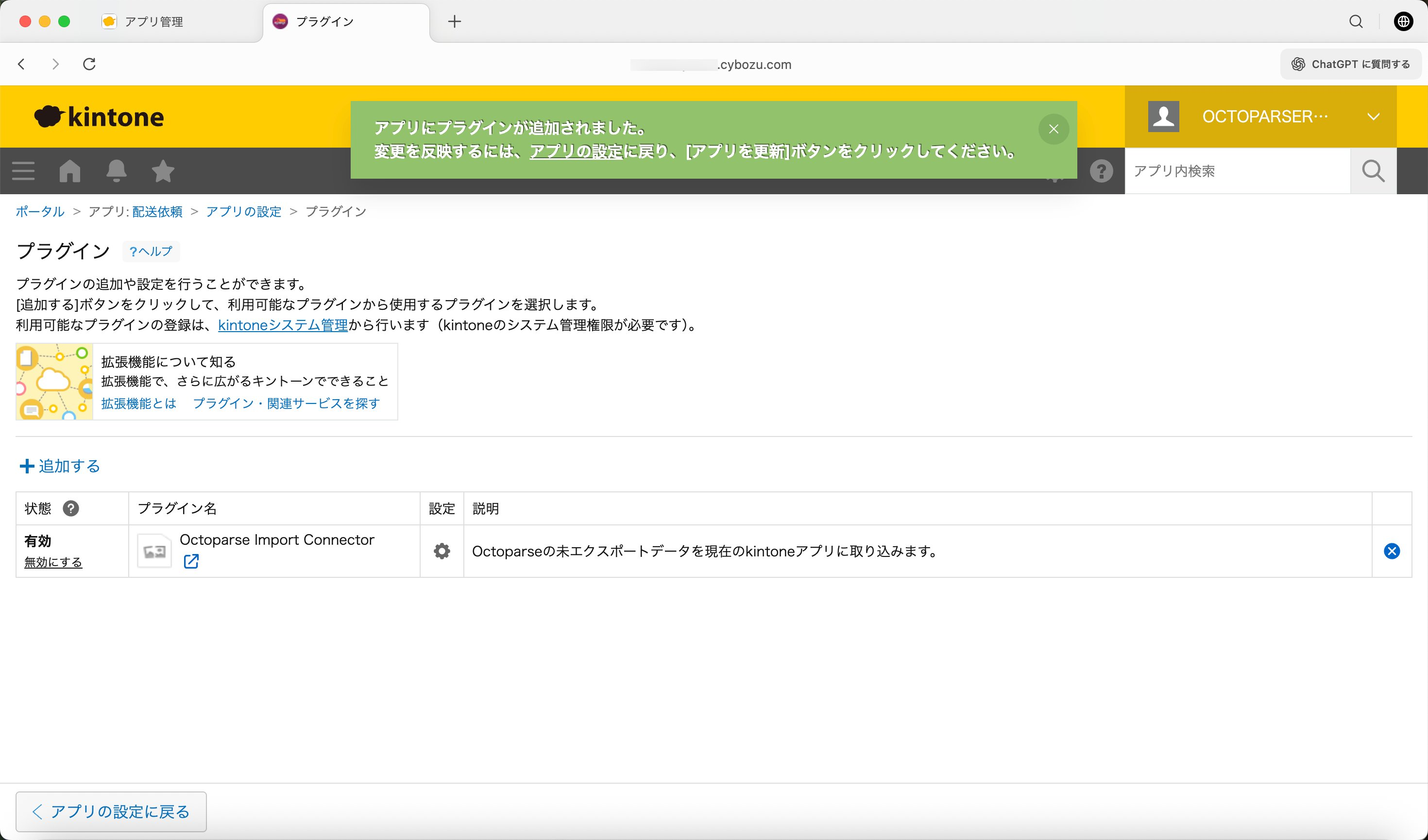

kintone(キントーン)との連携によるデータ活用の一気通貫化

Octoparseで取得したWebデータは、CSVやExcelとして出力するだけでなく、kintone(キントーン)のアプリへ直接登録することも可能です。

これにより、従来は分断されていた「データ収集」と「業務システムでの管理」が一体化され、データ活用の流れを大幅に効率化できます。

具体的には以下のような流れが実現します:

- Octoparseで競合価格・求人情報などを自動収集

- 取得データをそのままkintoneアプリに登録

- 営業・マーケ・分析チームが同一データを即時活用

これにより、「データを集めるための作業」と「業務で使うための管理」が分離されず、データ準備から活用までが一気通貫でつながる構造になります。

設定方法はこちら👇

どのデータ準備工程をOctoparseが担うのか

データ準備の5ステップの中で、Octoparseが主にカバーするのは以下の領域です:

① データ収集(Extract)

競合ECサイト、求人サイト、レビューサイトなどから必要な情報を自動取得します。

手作業でのコピー・貼り付けやAPI開発を不要にし、大規模データ収集を現実的にします。

② 初期フォーマット統一(Transformの前段階)

取得したデータはそのままでは分析できないため、以下のような初期整形が必要です:

- テキスト・数値・日付の基本的な構造化

- 不要な記号やHTMLタグの除去

- 列構造(カラム)の整理

Octoparseはこの段階までを自動化し、後続のクレンジング・統合工程に渡せる状態にします。

補足(重要な位置づけ)

その後の工程(本格的なクレンジング・社内データとの統合・BI投入)は、従来のデータ準備プロセスと同様に行われます。

つまりOctoparseは、

「データ準備の代替ツール」ではなく

「データ準備を社外データ領域まで拡張するためのインフラ」

として位置づけられます。

よくある質問(FAQ)

Q1. データ準備(データプレパレーション)とは何ですか?

収集したデータを分析・可視化できる状態に整える前処理の工程全般を指します。欠損値の補完・表記ゆれの統一・複数ソースの結合など、BIツールやAIモデルに投入する前に必要な作業をまとめてデータ準備と呼びます。データサイエンティストの業務の約80%がこの準備に費やされているという調査結果があるほど、分析成果を左右する重要な工程です。

Q2. ETLとの違いは何ですか?

ETLはエンジニアがシステム間のデータ連携を目的に使う技術的な処理で、コーディングが必要なケースが多いです。データ準備はビジネス担当者がGUIツールを使って分析のために行う前処理です。「どちらが優れているか」ではなく「誰が何のために使うか」で使い分けるものです。

Q3. プログラミングの知識がなくてもデータ準備はできますか?

できます。社内データの整備はBIツール(TableauやPower BIなど)のGUI機能で対応できます。社外データの収集はOctoparseのようなノーコードツールを使えば、Excelが扱える方であればプログラミングなしで実施可能です。

Q4. 社外データもデータ準備の対象になりますか?

なります。競合の価格・求人情報・SNSの口コミなど、社外Webデータも収集・フォーマット統一・社内データとの結合という「データ準備」のプロセスを経てBIに投入することができます。社内データと社外データを組み合わせることで、分析の解像度が大きく上がります。

Q5. データクレンジングとデータ準備の違いは何ですか?

データクレンジングはデータ準備の中の一工程です。クレンジングは欠損値・表記ゆれ・外れ値を処理する作業を指します。データ準備はそれより広い概念で、収集・集約から始まりクレンジング・変換・検証・BI投入までの一連の流れ全体を指します。

Q6. 社外データを収集する際の法的リスクはどう考えればいいですか?

Webスクレイピング自体は違法ではありませんが、

①対象サイトの利用規約でスクレイピングが禁止されていないか、

②著作権で保護されたコンテンツを無断で収集・再配布していないか、

③個人情報を含むデータを無断で収集していないか、

の3点を事前に確認することが重要です。

個人・社内利用の範囲に限定したデータ活用であれば、多くのケースでリスクは低く抑えられます。

まとめ

データ準備(データプレパレーション)は、分析の質を左右する最重要工程です。社内データを5つのステップで整備するだけでなく、競合価格・求人動向・口コミといった社外Webデータもデータ準備の対象として捉えることで、分析の解像度が大きく上がります。

まずは手元の社内データの棚卸しから始めつつ、社外データの収集も並行して検討してみてください。

社外データの収集から試したい場合は、Octoparseの無料プランで始めるのがおすすめです。また、スクレイピングツール12選の比較もツール選びの参考になります。