「Octoparseってどうやって使うの?」「プログラミングができなくてもスクレイピングできるの?」そんな疑問を持つ方に向けて、この記事ではOctoparseの使い方を初心者向けにゼロから解説します。

Octoparseはコーディング不要で、URLを貼り付けてクリックするだけでWebサイトからデータを自動収集できるツールです。世界600万人以上のユーザーが使うプラットフォームとして、Amazon・楽天・Googleマップなど600以上のサイトに対応したテンプレートを提供しており、初心者でも最短5分でデータ収集が始められます。

本記事では、スクレイピングが難しいと言われる理由・仕組みの解説から、Octoparseの具体的な操作手順・活用事例・よくある疑問まで、一記事で完全に網羅しています。

初心者にWebスクレイピングが難しいと言われる理由

日々の業務でデータ収集を手作業で行っていませんか?現在、1日あたり25エクサバイト(10億GB)ものデータがインターネット上で生成されており(出典:spacelift.io)、その90%以上は過去2年以内に生成されたものです。

※1エクサバイトは10億ギガバイトに相当します。

この情報爆発の時代に、手作業でのデータ収集は時間とコストの両面で非効率です。 Webスクレイピングへの関心が高まる一方で、「難しそう」「専門知識が必要では?」という声も多く聞かれます。Octoparseのサポートチームには毎月数百件の「使い方が分からない」という問い合わせが寄せられています。

そこで、初心者がつまずきやすいポイントを5つ整理しました。

プログラミング学習に時間と労力が掛かる

初心者がプログラミングを学び、Webスクレイピングを自力で実行するためには、相当な学習時間と労力が必要です。コードは基本的に英語で記述され、それぞれの意味を理解してコーディングすることは簡単ではありません。

近年では、プログラミングスクールなどの学習環境は整いつつありますが、そもそもプログラミングに対して興味や知的好奇心がないと、学習を続けること自体が難しく感じるでしょう。

全てのWebサイトが同じではない

世の中には無数のWebサイトがありますが、その構造はそれぞれ異なります。基本的なHTMLコンテンツのWebスクレイピングは比較的容易ですが、実際には複雑な仕様のWebサイトが数多く存在します。

また、同じWebサイトでもリニューアルなどで構造が変化する場合も少なくありません。Webスクレイピングを行うには、サイトの構造に合わせてWebスクレイパー(スクレイピングロボット)を調整する必要があります。例えば、PDF、CSV、Excelなどのファイルからスクレイピングを行うには、都度メンテナンスが必要です。

Webページの構造が複雑

多くの人気Webサイトは、HTMLやCSSに加えて、JavaScriptやAJAXといった複雑なプログラムによって構築されていることにより、スクレイピングが一層難しくなります。

また、ログインが必要なサイトや、動的にデータが変更されるサイトでは、Webスクレイパーが複雑な処理を求められるため、それに対応した設定が不可欠です。

スクレイピング防止対策への対応が求められる

Webサイトを持つ企業の多くは、自社のデータを保護するためにWebスクレイピングを防止する対策を講じています。対策を講じられたWebサイトは、スクレイピングボットを検出すると、アクセスをブロックします。

具体的なアクセスブロックには、CAPTCHAの導入や特定のIPアドレスのブロックが挙げられます。これらの対策を回避するには、IPアドレスの変更やプロキシの利用が必要です。これらのスクレイピング防止対策は常に進化しているため、それに対応し続けるための知識と技術が求められます。

スーパーサーバーが必要

少数のページをスクレイピングするのと、数百万ページを対象にするのとではやり方が全く異なります。大規模なスクレイピングには、I/Oメカニズム、分散クローリング、通信、タスクスケジューリング、重複チェックなどのスケーラブルなシステムが必要です。

これらの負荷に耐えるためには、高性能なサーバーが求められます。スーパーサーバーの設定や運用には専門知識が必要であり、初心者が扱うことは現実的ではありません。

Webスクレイピングの活用事例

Webスクレイピングを行えば多様な業務な場面で活用でき、今まで手作業で行っていた作業時間を大幅に短縮することができます。以下の表では、主なWebスクレイピングの用途と対象サイトの例をピックアップしました。

取得可能データ一覧

| テンプレート | 取得可能なデータ項目(表頭例) |

| SUUMO賃貸物件 | 物件名 / 家賃 / 管理費 / 間取り / 専有面積 / 築年数 / 最寄り駅 / 徒歩分 / 所在地 / 物件URL |

| Amazon Japan商品詳細 | 商品名 / ASIN / 価格 / 評価スコア / レビュー数 / 販売者 / カテゴリ / 在庫状況 / 商品URL |

| 楽天商品情報 | 商品名 / 価格 / ポイント倍率 / 評価数 / ショップ名 / カテゴリ / 商品URL |

| Googleマップ店舗リスト | 店舗名 / 住所 / 電話番号 / 評価スコア / クチコミ数 / 営業時間 / カテゴリ / ウェブサイトURL |

| Indeed求人(JP) | 求人タイトル / 会社名 / 勤務地 / 給与 / 雇用形態 / 掲載日 / 求人URL |

| リクナビNEXT求人 | 求人タイトル / 会社名 / 給与 / 勤務地 / 職種 / 応募条件 / 掲載期限 |

| マイナビ求人 | 求人タイトル / 会社名 / 業種 / 職種 / 給与 / 勤務地 / 応募資格 / 福利厚生 |

| Booking.comホテル | ホテル名 / 評価スコア / 料金 / 住所 / 客室タイプ / レビュー数 / 設備 |

| じゃらんホテル | ホテル名 / 地域 / 料金(1泊)/ 評価 / 口コミ数 / 設備 / チェックイン時間 |

| YouTube動画リスト | タイトル / チャンネル名 / 再生回数 / 高評価数 / 投稿日 / 動画URL / 説明文 |

上記以外にもWebスクレイピングはさまざまなシーンで活用できます。詳しい活用事例を知りたい方は「【活用事例】Webスクレイピングでビジネスを成長させる方法30選」をご覧ください。

Webスクレイピングの仕組みとは?

Webスクレイピングは、ウェブサイトからデータを自動的に抽出する技術です。しかし、その仕組みを正確に理解するには、IT初心者にとってやや難解に感じられるでしょう。ここでは、Webスクレイピングの仕組みを理解するために、データ収集までの流れをわかりやすく解説します。

ターゲットサイトの選定

どのウェブサイトからデータを抽出するかを決定します。例えば、Amazon、リクナビNEXT、iタウンページなど、目的や用途に合わせて選択しましょう。

HTML構造の解析

ターゲットサイトのHTML構造を解析します。HTMLはウェブページの骨格を形成する言語であり、各要素(テキスト、画像、リンクなど)の配置や構造が定義されています。

データ抽出のロジック作成

解析したHTML構造を基に、どの部分からデータを抽出するかを決定します。この際、特定のタグやクラスを指定してデータを抽出するロジックを作成します。

HTTPリクエストの送信

Webスクレイピングツールは、ターゲットサイトにHTTPリクエストを送信します。これは、ウェブブラウザがページを表示する際に行うリクエストと同様です。

レスポンスの取得

ターゲットサイトからのレスポンス(HTMLデータ)を受け取ります。このデータには、ページの全コンテンツが含まれています。

データの解析と抽出

受け取ったHTMLデータを解析し、事前に決定したロジックに基づいて必要なデータを抽出します。

データの保存

抽出したデータを保存します。保存形式はCSV、Excel、データベースなど、用途に応じて様々です。

Webスクレイピングツールのメリット

Webスクレイピングツールを使用することで、さまざまなメリットがあります。ここでは、具体的なメリットを詳しく解説します。

効率的なデータ収集が可能

Webスクレイピングツールを使用する最大のメリットは、効率的にデータを収集できる点です。従来の手動によるデータ収集では、膨大な時間と労力が必要でしたが、ツールを活用することでその手間を大幅に削減できます。

ツールは自動化されたプロセスでデータを収集するため、短時間で大量のデータを取得することが可能です。これにより、マーケティングリサーチや競合分析などの業務が迅速に進められ、ビジネスの意思決定をサポートします。

正確なデータの取得が可能

Webスクレイピングツールは、プログラムに基づいて正確にデータを抽出します。手動でデータを収集する場合、人為的なミスが発生する可能性がありますが、ツールを使用することでそのリスクを大幅に減らせることは大きなメリットです。

また、ツールを使うことで一貫した方法でデータを取得し、フォーマットの整ったデータを提供するため、後続の分析や処理がスムーズになります。結果として、データの品質が向上し、信頼性の高い情報に基づいた意思決定が可能になるでしょう。

コスト削減が可能

Webスクレイピングツールを利用することで、データ収集にかかるコストを大幅に削減できます。従来の手動データ収集には、人的リソースや時間が多く必要でしたが、ツールを使えばそのコストを削減できます。

また、外部業者にデータ収集を依頼する場合と比較しても、ツールを導入することで長期的なコスト削減が期待できるでしょう。これにより、限られたリソースを他の重要な業務に集中させることができ、全体的な業務効率が向上します。

多様なデータ形式に対応可能

Webスクレイピングツールは、さまざまなデータ形式に対応しているため、必要なデータを柔軟に取得できます。テキストデータだけでなく、画像や動画、音声データなどもスクレイピングすることが可能です。

これにより、幅広い用途でデータを活用でき、マーケティング戦略の多様化や、新しいビジネスチャンスの発見に繋がります。多様なデータ形式に対応できることで、より豊富な情報を収集し、分析の精度を高めることができます。

リアルタイムデータの取得が可能

Webスクレイピングツールを利用することで、リアルタイムでデータを取得することができます。特に、市場のトレンドや競合の動向をタイムリーに把握することは、ビジネスにおいて非常に重要です。

ツールを用いて定期的にデータを収集することで、最新の情報を常に手元に置き、迅速に対応することが可能になります。これにより、迅速な意思決定と柔軟な戦略調整が実現し、ビジネスの競争力を高めることが可能です。

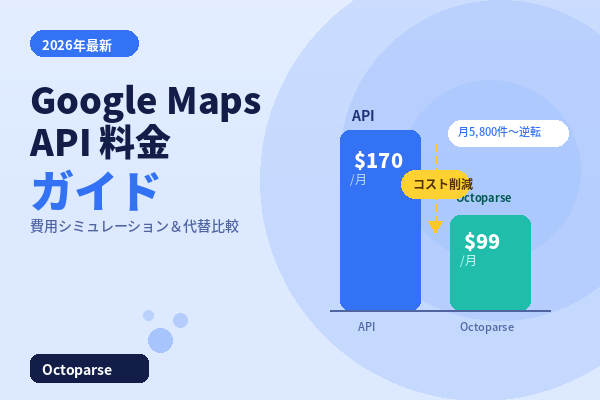

Octoparseと他ツールを徹底比較:あなたに合う選択はどれか

世の中のIT技術は日々進歩しており、Webスクレイピングツールもユーザーの使い勝手や利便性を追求するために、バージョンアップを繰り返しています。ここでは、簡単に扱えるWebスクレイピングツールを3つ紹介します。

ツール比較一覧

| 評価軸 | Octoparse ★ | Helium Scraper | Crawl Monster | VBA(Excel) | Beautiful Soup (Python) | Sequentum |

| 習得難易度 | ★★★★★ 超簡単 クリックだけ | ★★★☆☆ 中程度 ワークフロー設定要 | ★★★★☆ 比較的簡単 UI操作が中心 | ★★☆☆☆ やや難しい VBAコードが必要 | ★☆☆☆☆ 上級者向け Python必須 | ★★☆☆☆ やや難しい 企業IT担当者向け |

| 無料プラン | ✅ あり 月1万件まで | ❌ なし 買い切り$99〜 | ❌ なし 要問い合わせ | ✅ Excel付属 無料で使用可 | ✅ 完全無料 OSS | ❌ なし 企業向け有料のみ |

| テンプレート機能 | ✅ 600以上 Amazon楽天等 | ❌ なし 自分で作成のみ | ⚠️ カスタム抽出 限定的 | ❌ なし 都度コード作成 | ❌ なし 都度コード作成 | ⚠️ カスタム対応 エンタープライズ |

| クラウド実行 (PC不要) | ✅ あり 24時間自動収集 | ❌ なし ローカルのみ | ✅ あり クラウドベース | ❌ なし ローカルのみ | ❌ なし サーバー自己構築 | ✅ あり 大規模対応 |

| IP自動ローテーション | ✅ あり 自動ブロック回避 | ⚠️ 手動設定 プロキシ設定要 | ✅ あり クラウド経由 | ❌ なし 別途設定必要 | ❌ なし ライブラリ追加要 | ✅ あり エンタープライズ |

| 動的サイト対応 (JS/AJAX) | ✅ 対応 AI自動解析 | ✅ 対応 Advanced機能 | ✅ 対応 | ❌ 不可 静的ページのみ | ⚠️ 部分対応 Selenium等追加要 | ✅ 対応 高精度 |

| MCP対応 (AI連携) | ✅ 対応済み Claude/ChatGPT等 | ❌ 非対応 | ❌ 非対応 | ❌ 非対応 (VBAの性質上) | ❌ 非対応 (コード自体を書く) | ❌ 非対応 |

| 日本語サポート | ✅ 完全対応 公式JP版・JP FAQ | ⚠️ 英語のみ 公式サポート英語 | ⚠️ 英語中心 | ✅ 完全対応 MS公式JP資料 | ⚠️ 日本語記事は多い が公式は英語 | ❌ 日本語不可 英語のみ |

| 料金目安 | 無料〜 有料プランあり | 買い切り $99 / $499 | 要問い合わせ SEO企業向け | 0円 (Excel費用のみ) | 0円 (完全OSS) | 要見積もり 企業契約 |

| 対応OS | Windows / Mac | Windowsのみ | ブラウザ (クラウド) | Windows (Excel依存) | Windows/Mac/Linux (Python環境) | Windows中心 (エンタープライズ) |

初心者・非エンジニアにはOctoparseが最適な理由

Octoparseは、Octopus Data Inc.が開発・提供するノーコードWebスクレイピングツールです。世界180カ国・600万人以上のユーザーが利用しており、日本国内でも企業・研究機関・個人ユーザーに広く採用されています。

■ Octoparse 使い方の基本フロー(5ステップ)

実際にOctoparseでデータ収集を開始するまでの流れは、以下の5ステップです:

① 公式サイトからOctoparseを無料ダウンロード・インストール(所要約3分)

② 収集したいWebサイトのURLを貼り付けて「抽出開始」をクリック

③ AIが自動でページを解析し、データ項目を自動認識(クリック不要)

④ 「ワークフローを生成」→「保存して実行」でスクレイピング開始

⑤ CSV・Excel・JSON・HTMLなどお好みの形式でデータをエクスポート

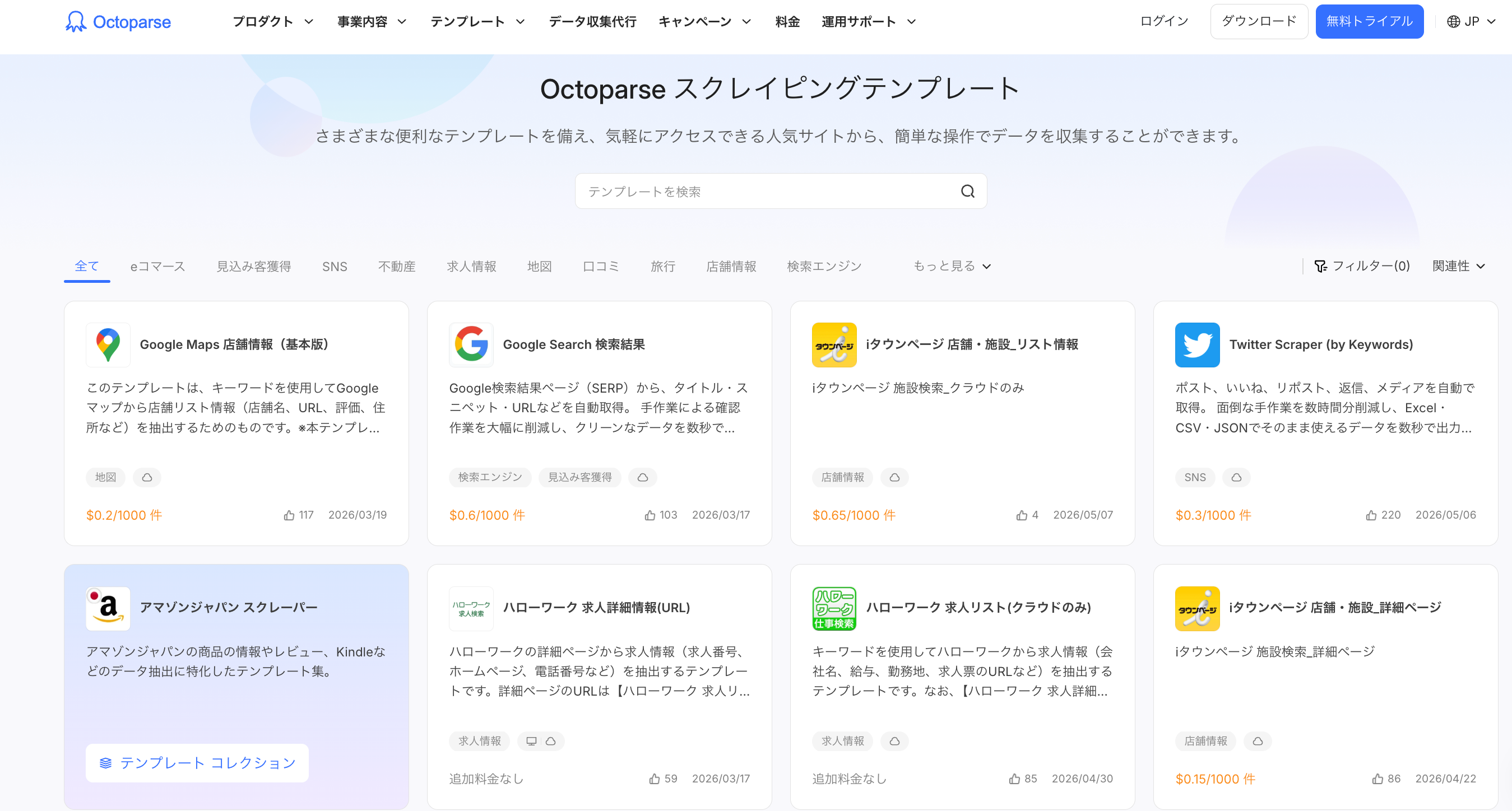

■ テンプレート活用で、さらに速く

Octoparseでは、Amazon・楽天市場・Googleマップ・Indeed・食べログなど主要サイト向けに事前設定済みテンプレートを600件以上用意しています。

キーワードを入力するだけでデータ収集できるため、設定時間はほぼゼロです。

■ 他ツールとの差別化ポイント

・AI自動解析:URLを貼るだけでワークフローを自動生成(Helium ScraperやCrawl Monsterにはない機能)

・IPローテーション:クラウドサーバーが自動でIPを変更しブロック回避(プログラミング不要)

・24時間クラウド実行:PCの電源を切っても定期収集が継続

・日本語サポート:国内向け公式ドキュメント・ブログ・サポートが充実

■ AIとの連携が可能(Octoparse MCP)

AIをOctoparseに接続し、必要な情報を対話形式で指示します。Octoparseは、テンプレートの選択、IPローテーションの設定、CAPTCHAの突破、ページネーションの処理など、スクレイピングタスクを実行し、クリーンで構造化されたデータを分析用にAIへ直接返します。

関連記事:

競合情報も営業リストも、ウェブデータをそのままExcel・CSV・Google Sheetsに出力。

コード不要、誰でも今日から。クリック操作だけで必要な項目を自動抽出。

Google Maps・食べログ・iタウンページ向けテンプレートで、リード獲得をすぐに開始。

クラウドで毎日・毎週自動実行。大量取得でも安定して、競合動向を常に把握。

MCP対応でAIエージェントと連携。収集データをAIに渡して分析・活用まで一気通貫。

クレジットカード不要で無料スタート。世界600万人以上が選んだ信頼のツール。

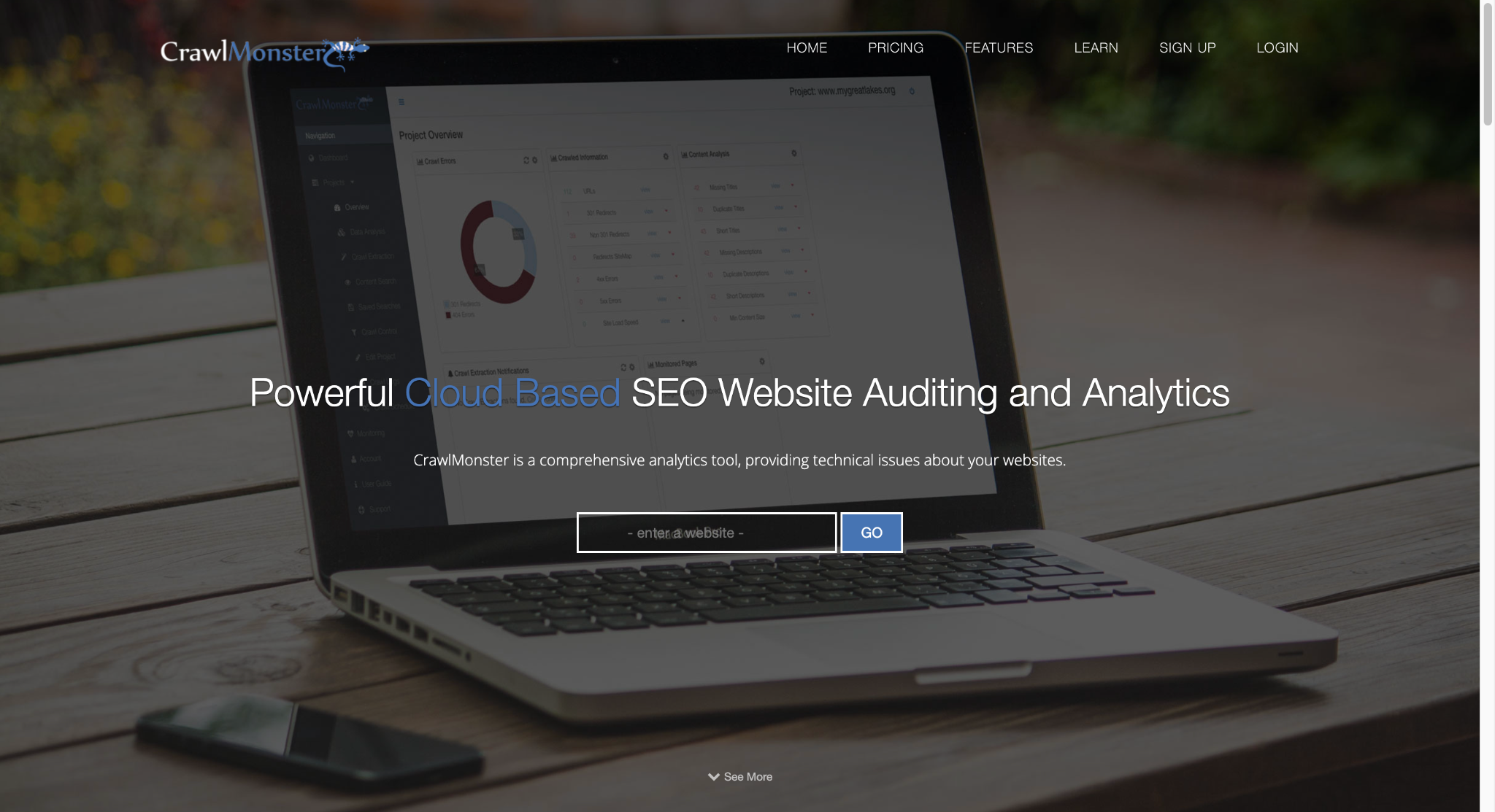

SEO担当者・サイト運営者にはCrawl Monsterが最適な理由

Crawl Monsterは、SEOやウェブサイトの技術的な問題を包括的に分析できるクラウドベースのツールです。このツールは、ウェブサイトのコンテンツをクラウドに保存し、簡単に検索、分析、問題の特定を行うことができます。特に優れている点は、カスタム抽出機能を使って、任意のデータを収集し、レポートを生成できることです。

また、リアルタイムでサイトをモニタリングし、技術的な問題やSEOパフォーマンスを継続的に監視する機能も備えています。これにより、ユーザーはサイトの最適化に必要なデータを迅速に得ることができ、効果的なSEO戦略を立てることができます。

Windowsユーザー・中級者にはHelium Scraperが刺さる理由

Helium Scraperは、直感的なインターフェースを提供するWebスクレイピングツールで、初心者でも簡単にデータ抽出を実現します。このツールの特徴は、複数のブラウザを使用して高速なデータ抽出を実現する点です。ユーザーは事前定義されたリストからアクションを選択して追加するだけで、シンプルなワークフローを構築できます。

また、より複雑なシナリオに対応するために、独自のアクションを定義したり、カスタムJavaScriptを使用することも可能です。さらに、プロキシローテーションや類似要素検出、リスト検出などの高度な機能を備えており、複雑なWebサイトのデータ収集も効率的に行えます。

ツール以外でWebスクレイピングを行う方法4選

初心者がWebスクレイピングを行うには、Webスクレイピングツールだけでなく、プログラミング言語やライブラリを活用する方法もあります。ここでは、VBA、Beautiful Soup、Sequentumの3つの方法について、それぞれ詳しく解説します。

ExcelユーザーのためのVBA入門

VBA(Visual Basic for Applications)は、Microsoft ExcelやAccessで利用できるプログラミング言語です。VBAを使えば、Excelシート上で直接Webスクレイピングを実行できます。この方法のメリットは、Excelユーザーにとって馴染みのある環境でスクレイピングを行える点です。

例えば、VBAを用いて特定のWebページにアクセスし、必要なデータを抽出してExcelシートに自動的に貼り付けることができます。これにより、手動でのデータ入力作業を省き、効率的にデータを収集することが可能です。VBAのスクリプトは比較的簡単に学べるため、プログラミング初心者でも取り組みやすい方法と言えるでしょう。

VBAを使ったスクレイピングの方法を知りたい方は、「【初心者向け】Excel (エクセル)VBAを使ってWebスクレイピングを実践する方法を解説!」を参考にしてください。

エンジニアのためのPython(Beautiful Soup)活用法

Beautiful Soupは、Pythonで使用される人気のあるHTML解析ライブラリです。このライブラリを使うことで、複雑なWebページのHTML構造を簡単に解析し、必要なデータを抽出することができます。Beautiful Soupの利点は、そのシンプルで直感的なAPIにあります。Pythonの基本的な知識があれば、短時間で強力なスクレイピングスクリプトを作成できます。

例えば、特定のタグやクラス名を指定してデータを抽出することができ、取得したデータをCSVやExcelファイルに保存することも容易です。Beautiful Soupは、データ解析や機械学習の前処理にもよく使用されるため、幅広い用途で活用できる強力なツールです。

Pythonを使ったスクレイピングの方法を知りたい方は、「PythonでWebスクレイピングする入門ガイド【サンプルコードあり】」を参考にしてください。

企業向け大規模収集ならSequentum

Sequentumは、エンタープライズ向けのWebスクレイピングサービスです。高度なデータ抽出が必要な企業や研究機関に適しており、大規模なデータ収集プロジェクトにも対応可能です。Sequentumの特徴は、その高度なカスタマイズ性とスケーラビリティです。

例えば、複雑なWebサイトのデータ構造にも対応できる強力な解析エンジンを備えており、リアルタイムでデータを収集して分析することができます。また、Sequentumはデータの品質管理や法的コンプライアンスにも配慮されており、信頼性の高いデータ抽出が可能です。企業のデータ戦略を支える重要なツールとして、多くの業界で採用されています。

MCP時代のスクレイピング:OctoparseとAIの連携

2026年、Octoparseは競合ツールに先駆けてMCP(Model Context Protocol)サーバーを実装しました。この機能は、「AIとスクレイピングツールの融合」という次世代のデータ収集パラダイムを体現しており、「octoparse 使い方」記事の独自優位性として積極的に紹介すべきポイントです。

MCP対応は現状Octoparseのみ

| 機能 | Octoparse | Helium Scraper | Crawl Monster | VBA | Beautiful Soup |

| MCP対応 | ✅ 対応済み | ❌ なし | ❌ なし | ❌ なし | ❌ なし |

| AI自然言語命令 | ✅ 対応 | ❌ | ❌ | ❌ | ❌ |

| Claude連携 | ✅ 正式対応 | ❌ | ❌ | ❌ | ❌ |

| ChatGPT連携 | ✅ 正式対応 | ❌ | ❌ | ❌ | ❌ |

| 設定時間 | 約3分 | N/A | N/A | N/A | N/A |

OctoparseをClaude/ChatGPTに連携すると、以下のような自然言語命令でスクレイピングが完結します:

- 「Amazonでキーワード『ノートパソコン』の上位20件の商品名・価格・評価を収集して」

- 「Googleマップで渋谷区のカフェ50件の店舗名・住所・評価・電話番号を取得して」

- 「Indeedで東京のPythonエンジニア求人を50件リスト化して、CSVでエクスポートして」

- 「先ほど作ったスクレイピングタスクを毎朝9時に自動実行するように設定して」

以前: URLを貼り付ける → ページ解析を待つ → 項目を手動選択 → ワークフロー生成 → 実行 → エクスポート(合計:初回15〜30分)MCP後: AIに日本語で指示するだけ → Octoparseが自動で全工程を実行(合計:1〜3分)

MCP連携のセットアップ手順(3分で完了)

| 1. Claude.aiを開き、設定 → コネクタ画面に移動する(Pro/Maxプランのみ。無料ユーザーはカスタムコネクタ1件まで追加可) 2.「コネクタを追加」→ Octoparseを検索するか、カスタムURLに https://mcp.octoparse.com を入力 3. Octoparseアカウントでログイン認証を行う(APIキーまたはOAuth) 4. Claudeのチャット画面からOctoparseのスクレイピング機能を自然言語で操作できるようになる ご不明な点がございましたら、Octoparseの公式MCPドキュメントをご参照いただくか、サポートチームまでお問い合わせください。 対応プラットフォーム: Claude Desktop・Claude.ai・ChatGPT・Cursor・Windsurf・VS Code(GitHub Copilot経由) ご注意: 公式のClaude専用コネクタは近日公開予定(2026年3月時点)。現在はカスタムコネクタとして利用可能。 |

よくある質問(FAQ)

Q1 Octoparseは無料で使えますか?

はい。Octoparseは無料プランを提供しており、月間最大10,000件のデータ収集が可能です。ローカル環境での実行に限られますが、基本的なスクレイピング機能はすべて使えます。まずは無料ダウンロードで試してから、必要に応じてクラウド実行・IPローテーション・スケジュール収集が使える有料プランへのアップグレードを検討しましょう。

Q2 Octoparseはプログラミングができなくても使えますか?

はい、プログラミングの知識は一切不要です。OctoparseはURLを貼り付けてクリックするだけでAIがページを自動解析し、データ抽出のワークフローを生成します。インストールからデータ収集完了まで、早ければ5分で完結します。

Q3 Octoparseでどんなサイトからデータ収集できますか?

Amazon・楽天・Googleマップ・Indeed・じゃらんなど、600以上の人気サイト向けテンプレートが用意されています。テンプレートにないサイトでも、カスタムモードで独自のスクレイパーを作成できます。JavaScriptやAJAXで動く動的サイト、ログインが必要なサイトにも対応しています。

Q4 スクレイピングは法的に問題ありませんか?

スクレイピング自体は技術として違法ではありませんが、対象サイトの利用規約やrobots.txtの指示を守ることが重要です。個人情報の無断収集や、サーバーに過度な負荷をかけるスクレイピングは問題となる場合があります。Octoparseには収集間隔の設定機能があり、適切な利用をサポートしています。詳しくはOctoparse公式の法的ガイドラインも参照してください。

Q5 Octoparseで収集したデータはどんな形式で保存できますか?

CSV・Excel(XLSX)・JSON・HTML・Google Sheetsなど複数の形式でエクスポートできます。また、APIやデータベースとの連携も可能で、収集したデータを既存のシステムやBIツールに直接取り込むことができます。

Q6 Octoparseのクラウド実行とローカル実行の違いは何ですか?

ローカル実行はあなたのPCで処理が行われるため、無料プランで利用可能ですが、PCの電源を切ると停止します。クラウド実行(有料プラン)ではOctoparseのサーバーで処理されるため、24時間365日PCを起動せずに自動収集でき、大量データ収集にも対応しています。

まとめ|将来性の高いWebスクレイピングを使いこなそう

Octoparseの使い方を一から理解できたでしょうか?プログラミングが不要で、URLを貼り付けてクリックするだけでWebスクレイピングが始められるOctoparseは、データ収集を初心者でも実務レベルで使える唯一のノーコードプラットフォームの1つです。

本記事で解説したポイントを改めて確認しましょう:

・Webスクレイピングが難しく感じる5つの理由

・スクレイピングの仕組み(7ステップ)

・Octoparseの使い方(5ステップ)と他ツールとの違い

・業種別の活用事例とテンプレート

・ツール以外の選択肢(VBA・Python・Sequentum)

まずは無料プランで試してみてください。世界600万人以上が使っているOctoparseを、あなたの業務データ収集にも活用しましょう。

競合情報も営業リストも、ウェブデータをそのままExcel・CSV・Google Sheetsに出力。

コード不要、誰でも今日から。クリック操作だけで必要な項目を自動抽出。

Google Maps・食べログ・iタウンページ向けテンプレートで、リード獲得をすぐに開始。

クラウドで毎日・毎週自動実行。大量取得でも安定して、競合動向を常に把握。

MCP対応でAIエージェントと連携。収集データをAIに渡して分析・活用まで一気通貫。

クレジットカード不要で無料スタート。世界600万人以上が選んだ信頼のツール。